2. 中国民用航空飞行学院 民机火灾科学与安全工程四川省重点实验室,广汉 618307;

3. 四川省全电通航飞行器关键技术工程研究中心,广汉 618307

2. Civil Aircraft Fire Science and Safety Engineering Key Laboratory of Sichuan Province, Civil Avitation Flight University of China, Guanghan, 618307;

3. Sichuan Key Technology Engineering Research Center for All-electric Navigable Aircraft, Guanghan, 618307

随着城市化的快速发展,全球范围内的火灾事故频发,火灾的发生易对社会造成严重危害。开展图像型火灾检测算法的相关研究有助于提取火焰或烟气的形态特征,提升火灾预警工作的效率。近年来,计算机视觉领域的快速发展推进了火灾探测方面的相关研究。目前用于火灾检测的算法有CNN[1]、Fast-RCNN[2]和YOLO系列 [3-5]等,其中Fast-CNN系列的两阶段算法的检测速度较慢,而YOLO系列的一阶段算法更满足火灾检测的实时性需求。

为了得到更优的火焰特征提取网络,Dai等[6]使用MobileNet网络替换YOLOv3的主干网络,赵媛媛等[7]在YOLOv3网络架构的基础上增加了检测层,但是以上方法无法满足检测火焰时所需的精度需求。Uddin等[8]评估了YOLOv5和YOLOv8算法的性能,以探索高精度的火灾预警模型。Yar等[9]通过改进YOLOv5的网络架构,获得较低复杂度、较高精度的火灾图像检测模型。Qin等[10]将深度可分离卷积与YOLOv3相结合,使该模型的火灾检测性能良好,但其检测速度仅为35 fps。为了满足火灾探测算法所需的较高精度与较快速度,可选择一阶段算法中性能强悍的实时检测器YOLOv8作为基线算法。该算法是2023年提出的YOLO系列算法的版本之一。由于火灾背景复杂,火焰和烟雾具有不规则形状且颜色深浅不一,采用YOLOv8算法实现高精高速检测仍然可能出现漏检与误检的问题。

轻量型神经网络结构因具备良好的网络性能而被广泛研究。王云艳等[11]通过提出FMDA-net并改进MobileNetV3的Bneck块得到MobileNetV3+作为YOLOv4主干网络,用于遥感图像检测。袁硕等[12]提出了一种以ShuffleNetV2网络为基础,插入ECA模块、使用Mish激活函数和深度可分离卷积改进的岩石图像识别算法,解决了传统算法步骤繁琐和算力需求量大的问题。

本文首先采用一种更优的轻量型模块SlimNeck[13]来优化YOLOv8算法的颈部网络,其次将YOLOv8算法的推理框架替换为切片辅助超推理(slicing aided hyper inference, SAHI)[14],进一步加强算法对小目标的检测能力。本研究针对优化火灾检测系统、降低火灾损失具有重要的推动价值和实际应用价值。

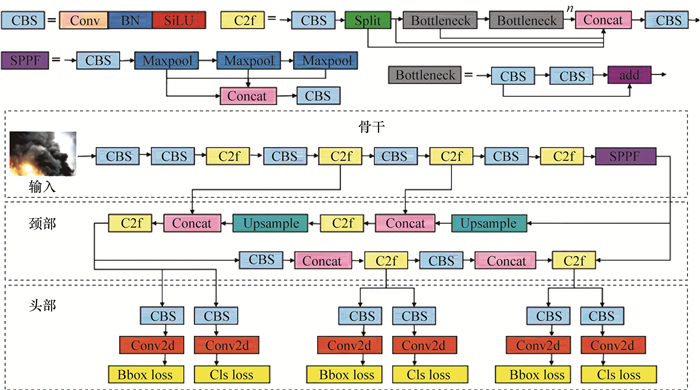

1 研究方法 1.1 YOLOv8算法YOLOv8的网络结构融合了YOLO系列算法的网络结构并加以改进,比同系列已有算法具备更优的检测性能。例如,YOLOv8沿用了YOLOv5中基于跨阶段局部网络(CSP)与快速空间金字塔池化(SPPF)的骨干网络以及基于路径聚合网络(PAN)[15]和特征金字塔网络(FPN)[16]的颈部网络,但是去除了YOLOv5颈部网络中上采样阶段的卷积结构,并采用更轻量、更高特征信息提取能力的C2f模块代替骨干和颈部的C3模块。值得注意的是,YOLOv8还采用解耦头(decoupled head)来提高模型训练和推理的效率。YOLOv8的网络结构如图 1所示,其中n为C2f模块内bottleneck的个数,用于调整模型的复杂度和性能以适应不同的应用场景和需求;CBS为“Conv+BN+SiLU”的基本结构,Conv表示卷积操作,通过卷积可以实现特征提取,改变特征图的分辨率和通道数,BN表示批量归一化(batch normalization),有助于加速模型的训练和提高模型的稳定性,SiLU表示一种激活函数,即sigmoid加权线性单元(sigmoid weighted linear unit),为模型引入了非线性特性,增强模型的表达能力。由图可知,YOLOv8的骨干网络由大量卷积结构来提取特征信息,并且利用残差结构来降低网络尺寸从而提高网络性能。颈部网络使用多尺度融合方法来融合骨干网络输出的不同尺寸的特征图,输出3种大小为20×20, 40×40和80×80特征图,以此增强网络表征能力。头部网络的任务是对颈部输出的特征图进行目标的检测与分类,其中使用大量卷积层来输出检测结果并利用平均池化对目标进行分类。

|

| 图 1 YOLOv8网络结构 |

1.2 改进YOLOv8算法

由于火灾的背景图像比较复杂,火焰和烟雾呈现不规则形态,实时检测器常会出现精度较低、误检、漏检和抗干扰能力差等情况。本文通过优化YOLOv8算法以实现其在执行实时检测任务时,具备更加鲁棒的检测性能。

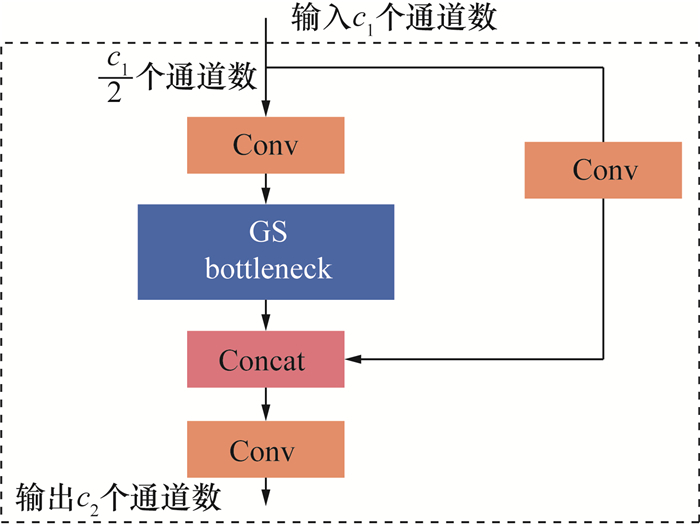

1.2.1 优化YOLOv8网络结构SlimNeck是一种为实现检测器更高的成本效益而提出的设计范式。SlimNeck的网络结构是综合了CNN学习效率的几种强化方法设计所得,例如DensNet[17]、VoVNet[18]和CSPNet[19]。SlimNeck使用了单阶段聚合方法来建立跨级局部网络(GSCSP)模块VoV-GSCSP,结构如图 2所示。其中c1和c2分别为该模块输入和输出的通道(channel)数量。该过程用以实现对特征图的变换和特征提取。该模块能够减少运算开销,降低网络结构复杂度,并保持足够的精度。

|

| 图 2 VoV-GSCSP模块结构 |

Li等[13]将SlimNeck集成到YOLOv3-tiny、YOLOv4-tiny和YOLOv5n网络中,经过实验对比发现,采用SlimNeck的网络模型以更少的延迟时间和网络参数,获得了更高的检测精度和更快的速度。

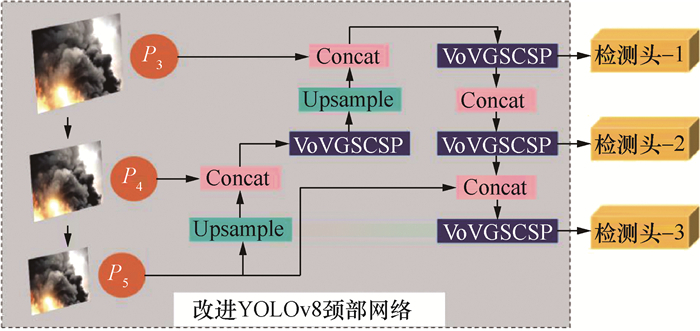

因此本文通过将VoV-GSCSP代替颈部网络中的C2f层,将SlimNeck模块集成到YOLOv8颈部网络,以增强YOLOv8捕捉火焰和烟雾特征信息的能力。获得的SlimNeck-YOLOv8算法如图 3所示。由图可知,YOLOv8的骨干网络(backbone)通过一系列卷积操作输出不同分辨率的特征图,这些特征图经过颈部网络进行特征融合和处理。其中P3、P4、P5分别对应不同大小和语义层次的特征图。

|

| 图 3 SlimNeck-YOLOv8算法 |

1.2.2 优化YOLOv8推理框架

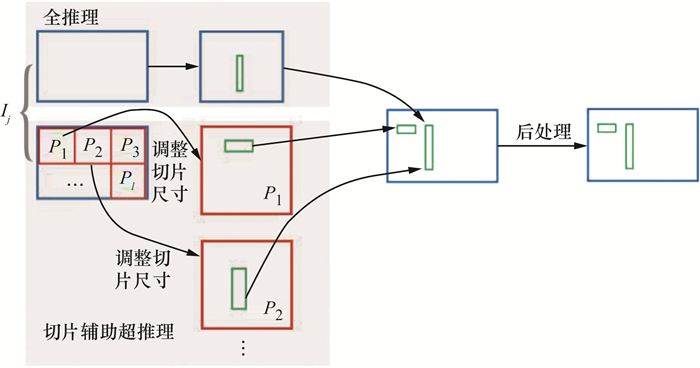

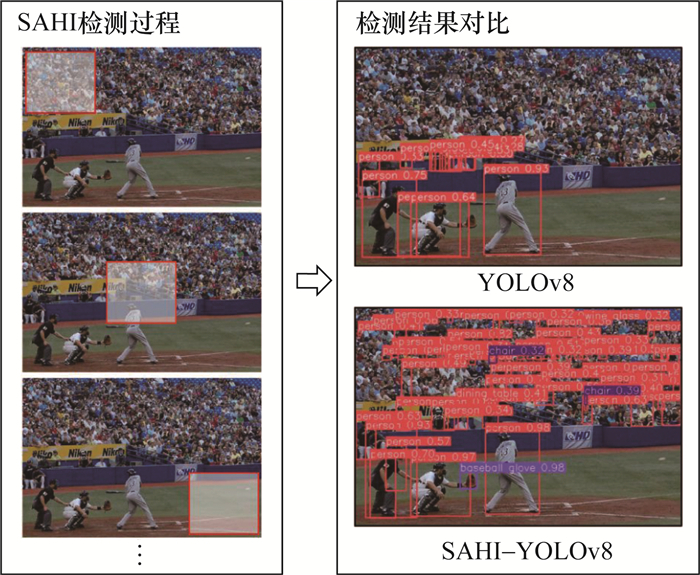

切片辅助超推理(slicing aided hyper inference,SAHI)是一种用于微调和推理阶段解决小目标检测问题的通用框架。具体来说,将图像分割成若干个子图像,从而增加微小目标的像素面积。如图 4所示,任意一幅图像Ij(蓝色框)在推断过程中都会被分割为l个重叠的切片(红色框),记为P1, P2, …, Pl。通过保持长宽比来调整切片的尺寸,同时对每个切片包含的内容进行预测。在此期间,随着切片尺寸的减小,模型对于较大目标的检测性能可能会降低。因此,为了更准确地检测较大目标,使用非极大值抑制(non-maximum suppression,NMS)算法NMS[20]将重叠图像的预测结果与原始图像的全推理(full-inference)相结合,并最终将其转换为原始图像尺寸。

|

| 注:全推理为对原始图像进行完整的推理,即直接对整张图像进行目标检测,而不进行切片操作,后处理为对模型推理结果进行的一系列后续处理操作,以得到更加准确且可用的检测结果,常见的后处理操作包括NMS。 图 4 切片辅助超推理的原理架构 |

为了进一步展示SAHI框架的检测过程和优势,将YOLOv8算法的推理框架替换为SAHI,并在coco(common objects in context)128数据集上推理测试。该数据集包括复杂的图像背景并设置有80个目标类别,如图 5所示。

|

| 注:英文单词为目标类别,数字为目标框置信度。 图 5 SAHI的检测性能对比 |

由图可知,SAHI将左侧图像切割成若干小块来增加目标特征的像素大小,进而提高对小目标特征信息的捕获能力。因此,本文汲取SAHI的优势,在SlimNeck-YOLOv8的基础上进一步优化算法,利用SAHI框架取代原有的推理方式,构建SlimNeck-YOLOv8+SAHI算法,降低模型漏检和误检率,提高其抗干扰能力。

2 实验准备 2.1 实验设备和参数本文实验主要采用计算机系统进行图像处理、模型训练等操作,所采用的设备和参数如表 1所示。

| 设备 | 参数 |

| 处理器 | Intel(R) Core (TM)i9-13900CPU@ 3.70GHz |

| 运行内存 | 128 G |

| 操作系统 | Windows |

| GPU | NVIDIA GeForce RTX 4090 |

| GPU内存 | 128 G |

| 编程工具 | PyCharm |

| 编程语言 | Python |

| 深度学习框架 | PyTorch |

2.2 评估指标

本文用于衡量实验结果的评估指标有查准率Pr(precision), 查全率R(recall), 平均精度(mAP),每秒帧数(frames per second, FPS)和每秒10亿次浮点运算数(GFLOPs)。Pr表示预测出的真实正例占所有预测为正确的比例,用来衡量预测结果中,正例被预测正确的概率;R表示预测出的真实正例占实际正样本总量的比例,用来反映漏检情况。计算公式如下:

| $ \operatorname{Pr}=\frac{\mathrm{TP}}{\mathrm{TP}+\mathrm{FP}}, $ | (1) |

| $ R=\frac{\mathrm{TP}}{\mathrm{TP}+\mathrm{FN}} . $ | (2) |

其中:TP为真正例,指被正确地判定为正例的样本数量,FP为假正例,指被错误地判定为正例的样本数量。

mAP表示数据集中所有类别的平均精度(AP)的均值,其中N为检测的目标类别数量。

| $ \mathrm{mAP}=\frac{1}{N} \sum\limits_{i=1}^N \mathrm{AP}, \quad P=\int_0^1 P(R) \mathrm{d} R . $ | (3) |

FPS用来衡量图像处理或模型检测速度。可由每帧处理时间求倒数获得。GFLOPs用于衡量模型在推断或训练时的计算性能。

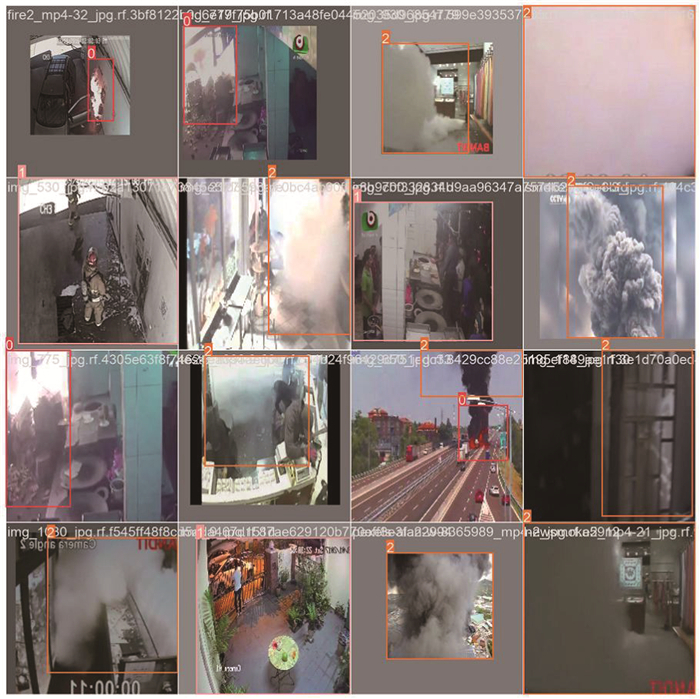

2.3 图像预处理采用马赛克(mosaic)方法在数据预处理阶段对图像进行增强处理,如图 6a所示。使用GitHub平台提供的公开的火灾数据集fire-8[21],该数据集内的火灾场景包括室内火灾场景、室外火灾场景和森林火灾场景。将火灾数据集的类别分为火焰和烟雾,干扰项(default)设置为火焰与烟雾的复杂背景图像中的人或其余物体。

|

| 图 6 火焰与烟雾图像(经马赛克增强处理) |

数据集预处理可视化结果如图 7所示,由训练集中每个类别的样本数量分布(见图 7a)可知,训练集的样本中有3种目标类别,分别为火焰、干扰项和烟雾,样本总数为877个,而烟雾样本数最多;由此判断出模型在训练过程中的收敛方向会偏向烟雾类别,导致模型性能在烟雾类别的检测方面更具优势。由目标边界框的尺寸和数量分布(见图 7b)可知,输入图像的目标尺寸都小于或等于640像素,其中较多的目标框尺寸靠近640像素;由此判断出数据集中的大目标数量较多,而小目标数量相对较少。由数据集中目标中心点相对于整幅图的位置分布(见图 7c)和目标相对于整幅图的高宽比例分布(见图 7d)可知,图像中的目标位置多数集中在图像的中心区域,这是由于数据集中包括较多的大范围或近距离火灾场景,导致目标特征的范围覆盖面积较大。

|

| 图 7 火焰与烟雾图像可视化处理 |

3 结果与讨论

为了充分验证本文所提算法的有效性,在包含3个目标类别的fire-8数据集和包含80个目标类别的coco128数据集上展开同等条件的实验。首先,通过消融实验来探究SlimNeck-YOLOv8算法的性能并分析改进模块的贡献。接着,将SlimNeck-YOLOv8算法与其他相关算法作对比,以评估该算法的真实检测性能。最后,将新的推理框架SAHI代替SlimNeck-YOLOv8算法内原YOLOv8推理框架,形成SlimNeck-YOLOv8+SAHI算法,并与SlimNeck-YOLOv8模型进行检测效果的对比。

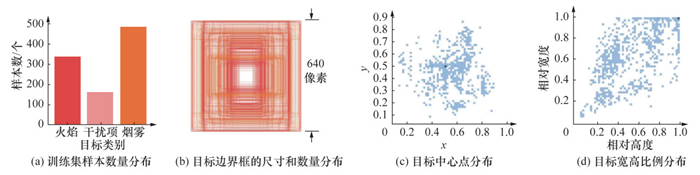

3.1 SlimNeck-YOLOv8本节采用的模型性能评估指标为R、mAP、FPS和GFLOPs。消融实验和对比实验在2个数据集上的模型训练轮数(epoch)分别设置为1 000和300,其他实验条件保持一致。消融实验的结果如表 2所示。由表可知,SlimNeck-YOLOv8模型在fire-8数据集上的GFLOPs比YOLOv8模型在fire-8数据集上的低,这表明对YOLOv8颈部网络的改进有效减轻计算负担,并且收获了更优的模型性能。SlimNeck-YOLOv8模型在fire-8数据集上的mAP和R比YOLOv8模型在fire-8数据集上的分别上涨0.2%和2.7%,检测速度提高35 fps,这表明SlimNeck-YOLOv8可以在保持网络结构较轻量的同时捕获更多火焰与烟雾的特征信息。我们在更多类别的数据集coco128上进行同等条件的实验,结果进一步证明SlimNeck-YOLOv8模型的性能优势。

| 数据集 | 模型 | 评估指标 | |||

| R | mAP | FPS | GFLOPs | ||

| fire-8 | YOLOv8 | 0.867 | 0.917 | 48 | 8.9 |

| SlimNeck-YOLOv8 | 0.894 | 0.919 | 83 | 8.0 | |

| coco128 | YOLOv8 | 0.523 | 0.605 | 44 | 8.9 |

| SlimNeck-YOLOv8 | 0.770 | 0.830 | 95 | 8.2 | |

训练的过程如图 8所示。由图可知,在训练次数从0上升至1 000的阶段内,SlimNeck-YOLOv8模型的mAP的上升速度比YOLOv8模型快,达到平衡后的mAP值分别约为0.919和0.917,表明了前者具备比后者更优的精度。

|

| 图 8 模型训练中平均精度(mAP)的变化 |

SlimNeck-YOLOv8与其他相关的经典检测算法在2个数据集上的对比结果分别如表 3和表 4所示。由表 3可知,在fire-8数据集上,SlimNeck-YOLOv8算法的Pr为0.944、mAP为0.889,FPS为77,均优于SSD[22]和MDSSD[23]算法。同时,SlimNeck-YOLOv8的性能优于其他YOLO系列算法(YOLOv5算法源代码为https://github.com/ultralytics/yolov5,YOLOv6算法源代码为https://github.com/meituan/YOLOv6),例如与基于较小网络结构的YOLOv5相比,SlimNeck-YOLOv8具备更高的检测精度及速度。

| 模型 | 评估指标 | ||

| Pr | mAP | FPS | |

| SSD | 0.866 | 0.859 | 42 |

| MDSSD | 0.880 | 0.864 | 37 |

| YOLOv3 | 0.879 | 0.875 | 47 |

| YOLOv5 | 0.938 | 0.873 | 44 |

| YOLOv6 | 0.900 | 0.88 | 32 |

| YOLOv8 | 0.882 | 0.882 | 39 |

| SlimNeck-YOLOv8 | 0.944 | 0.889 | 77 |

| 模型 | R | mAP | FPS |

| SSD | 0.67 | 0.733 | 72 |

| ESSD | 0.712 | 0.768 | 64 |

| MDSSD | 0.69 | 0.702 | 58 |

| YOLOv3 | 0.703 | 0.757 | 71 |

| YOLOv5 | 0.585 | 0.697 | 75 |

| YOLOv6 | 0.689 | 0.764 | 69 |

| YOLOv8 | 0.686 | 0.744 | 73 |

| SlimNeck-YOLOv8 | 0.836 | 0.866 | 75 |

同样地,在coco128数据集上的检测效果也进一步验证了SlimNeck-YOLOv8模型的性能优势。由表 4可知,在coco128数据集上,SlimNeck-YOLOv8算法获得了较其他算法更高的0.836的查全率、0.866的平均精度和75 fps的速度。

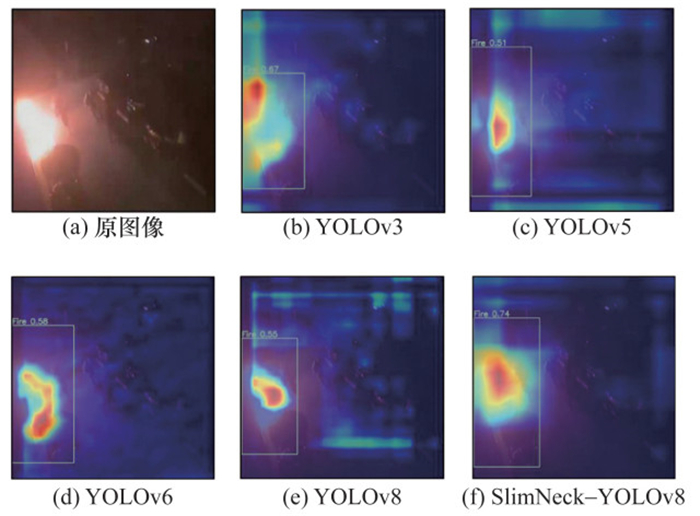

此外,为了深入了解模型如何识别火焰的特征信息,充分分析不同模型产生检测性能差异的原因,任意选取了几种YOLO系列的算法使用Grad-CAM[24]进行图像检测的可视化,所选图像仅含火焰一种类别,模型可直接通过捕捉火焰的特征信息对其进行识别,检测结果如图 9所示,其中检测框上方左侧的文字为目标类别火焰(Fire),而右侧的数字为目标框置信度。由图可知,SlimNeck-YOLOv8算法的目标框置信度为0.74,优于其他模型,且能够更全面地捕获火焰形态,具备更高的特征信息洞察力和敏锐度。

|

| 注:Fire为目标类别火焰,数字为目标框置信度。 图 9 火焰图像可视化结果对比 |

3.2 SlimNeck-YOLOv8+SAHI算法

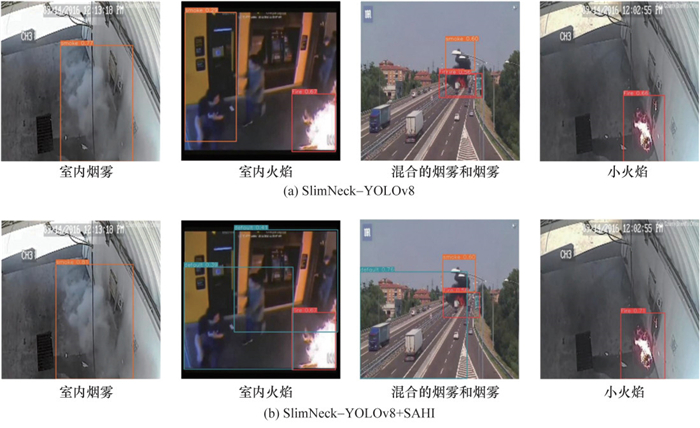

为强化SlimNeck-YOLOv8算法对火焰与烟雾的检测能力,用SAHI框架代替SlimNeck-YOLOv8算法原有的推理框架,构建出SlimNeck-YOLOv8+SAHI算法,并围绕检测框置信度与SlimNeck-YOLOv8算法进行对比,结果如图 10所示,其中红色框、橙色框和蓝色框检测的目标分别为火焰、烟雾和干扰项。由图可知,室内烟雾和小火焰中检测框置信度从SlimNeck-YOLOv8算法的0.77、0.66分别提升到SlimNeck-YOLOv8+ SAHI算法的0.81、0.71;室内火焰中SlimNeck-YOLOv8+SAHI算法没有出现SlimNeck-YOLOv8算法中误检烟雾的情况,并较好地识别出了干扰项;混合的火焰和烟雾中,SlimNeck-YOLOv8算法出现赘余检测框,而SlimNeck-YOLOv8+SAHI算法中并没有出现,且后者识别出了干扰项。因此,在检测置信度、误检和抗干扰方面,SlimNeck-YOLOv8+SAHI算法均表现出比SlimNeck-YOLOv8更优的性能,这表明SAHI框架的引入进一步优化了SlimNeck-YOLOv8检测火焰与烟雾的能力。

|

| 图 10 SlimNeck-YOLOv8与SlimNeck-YOLOv8+SAHI的检测结果对比 |

4 结论

本文提出了一种用于检测火焰与烟雾的改进YOLOv8算法,其集成了SlimNeck和SAHI分别用于优化YOLOv8的颈部网络和推理框架。为了验证该算法的有效性,在fire-8数据集和coco128数据集上进行了消融实验和算法对比,最后进行了检测效果对比。结果表明,SlimNeck-YOLOv8算法在火焰和烟雾检测方面较其他相关算法具备更大的优势,达到了0.944的查准率、0.889的平均精度和77 fps的检测速度。SlimNeck-YOLOv8算法检测火焰和烟雾的查全率、精度和检测速度较原YOLOv8算法分别提高了2.7%、0.2%和35 fps。在SlimNeck-YOLOv8算法的基础上集成SAHI推理框架,提高了算法在置信度、误检和抗干扰方面的火焰和烟雾检测性能,SlimNeck-YOLOv8+SAHI算法表现出了更好的鲁棒性,能更快速、更准确地提取火焰与烟雾的特征信息,有效改善了火灾检测中出现的误报、漏报现象。考虑到YOLO系列算法常用于大范围的森林火灾探测,在后续工作中将增设更多森林火灾场景以扩充数据集,深入探究SlimNeck-YOLOv8+SAHI算法的适用性。

| [1] |

GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hierarchies for accurate object detection and semantic segmentation[C]// Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Columbus, USA: IEEE, 2014: 580-587.

|

| [2] |

GIRSHICK R. Fast R-CNN[C]// Proceedings of IEEE International Conference on Computer Vision. Santiago, Chile: IEEE, 2015: 1440-1448.

|

| [3] |

REDMON J, FARHADI A. YOLO9000: Better, faster, stronger[C]// Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Honolulu, USA: IEEE, 2017: 6517-6525.

|

| [4] |

REDMON J, FARHADI A. YOLO9000: Better, faster, stronger[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Honolulu, USA: IEEE, 2017: 6517-6525.

|

| [5] |

WANG C Y, BOCHKOVSKIY A, LIAO H-Y M. YOLOv7: Trainable bag-of-freebies sets new state-of-the-art for real-time object detectors[C]// Proceedings of IEEE/CVF Conference on Computer Vision and Pattern Recognition. Vancouver, Canada: IEEE, 2023: 7464-7475.

|

| [6] |

DAI Z T. Image flame detection method based on improved YOLOv3[J]. IOP Conference Series: Earth and Environmental Science, 2021, 693: 012012. |

| [7] |

赵媛媛, 朱军, 谢亚坤, 等. 改进Yolo-v3的视频图像火焰实时检测算法[J]. 武汉大学学报(信息科学版), 2021, 46(3): 326-334. ZHAO Y Y, ZHU J, XIE Y K, et al. A real-time video flame detection algorithm based on improved Yolo-v3[J]. Geomatics and Information Science of Wuhan University, 2021, 46(3): 326-334. (in Chinese) |

| [8] |

UDDIN M N, SAKIB M S I, NAWER S, et al. Improved fire detection by YOLOv8 and YOLOv5 to enhance fire safety[C]// Proceedings of the 2023 26th International Conference on Computer and Information Technology (ICCIT). Cox's Bazar, Bangladesh: IEEE, 2023: 1-6.

|

| [9] |

YAR H, KHAN Z A, ULLAH F U M, et al. A modified YOLOv5 architecture for efficient fire detection in smart cities[J]. Expert Systems with Applications, 2023, 231: 120465. |

| [10] |

QIN Y Y, CAO J T, JI X F. Fire detection method based on depthwise separable convolution and YOLOv3[J]. International Journal of Automation and Computing, 2021, 18(2): 300-310. |

| [11] |

王云艳, 罗帅, 王子健. 基于改进MobileNetV3的遥感目标检测[J]. 陕西科技大学学报, 2022, 40(3): 164-171. WANG Y Y, LUO S, WANG Z J. Remote sensing target detection based on improved MobileNetV3[J]. Journal of Shaanxi University of Science & Technology, 2022, 40(3): 164-171. (in Chinese) |

| [12] |

袁硕, 刘玉敏, 安志伟, 等. 基于改进ShuffleNetV2网络的岩石图像识别[J]. 吉林大学学报(信息科学版), 2023, 41(3): 450-458. YUAN S, LIU Y M, AN Z W, et al. Rock image recognition based on improved ShuffleNetV2 network[J]. Journal of Jilin University (Information Science Edition), 2023, 41(3): 450-458. (in Chinese) |

| [13] |

LI H, LI J, WEI H, et al. Slim-neck by GSConv: A better design paradigm of detector architectures for autonomous vehicles[J]. arXiv preprint arXiv: 2206.02424, 2022. |

| [14] |

AKYON F C, ALTINUC S O, TEMIZEL A. Slicing aided hyper inference and fine-tuning for small object detection[C]// Proceedings of 2022 IEEE International Conference on Image Processing (ICIP). Bordeaux, France: IEEE, 2022: 966-970.

|

| [15] |

LIN T Y, DOLLÁR P, GIRSHICK R, et al. Feature pyramid networks for object detection[C]//Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Honolulu, USA: IEEE, 2017: 936-944.

|

| [16] |

LIU S, QI L, QIN H F, et al. Path aggregation network for instance segmentation[C]// Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Salt Lake City, USA: IEEE, 2018: 8759-8768.

|

| [17] |

HUANG G, LIU Z, VAN DER MAATEN L, et al. Densely connected convolutional networks[C]// Proceedings of IEEE Conference on Computer Vision and Pattern Recognition. Honolulu, USA: IEEE, 2017: 2261-2269.

|

| [18] |

LEE Y, HWANG J W, LEE S, et al. An energy and GPU-computation efficient backbone network for real-time object detection[C]// Proceedings of IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. Long Beach, USA: IEEE, 2019: 752-760.

|

| [19] |

WANG C Y, LIAO H Y M, WU Y H, et al. CSPNet: A new backbone that can enhance learning capability of CNN[C]// Proceedings of IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. Seattle, USA: IEEE, 2020: 1571-1580.

|

| [20] |

NEUBECK A, VAN GOOL L. Efficient non-maximum suppression[C]// Proceedings of the 18th International Conference on Pattern Recognition (ICPR'06). Hong Kong, China: IEEE, 2006: 850-855.

|

| [21] |

ABONIA S. YOLOv8-fire-and-smoke-detection[EB/OL]. [2024-03-26]. https://github.com/Abonia1/YOLOv8-Fire-and-Smoke-Detection/tree/main/datasets/fire-8.

|

| [22] |

LIU W, ANGUELOV D, ERHAN D, et al. SSD: Single shot MultiBox detector[C]// Proceedings of 14th European Conference on Computer Vision. Amsterdam, The Netherlands: Springer, 2016: 21-37.

|

| [23] |

CUI L S, MA R, LV P, et al. MDSSD: multi-scale deconvolutional single shot detector for small objects[J]. Science China Information Sciences, 2020, 63(2): 120113. |

| [24] |

SELVARAJU R R, COGSWELL M, DAS A, et al. Grad-CAM: Visual explanations from deep networks via gradient-based localization[C]// Proceedings of IEEE International Conference on Computer Vision. Venice, Italy: IEEE, 2017: 618-626.

|