1 数据收集

1.1 被试招募

表 1 样本集人口学信息统计 |

| 人口特征及相关量表 | 抑郁症患者 | 对照组 |

| 平均年龄 | 15.50(1.67) | 18.53(0.90) |

| 人数(男/女) | 36/10 | 24/16 |

| Hamilton抑郁量表 (HAMD-24) | 22.97(10.24) | — |

| 抑郁症筛查量表(PHQ-9) | 15.79(5.16) | 3.15(2.42) |

| 世界卫生组织精神残疾评定量表(WHO-DAS 2.0) | 28.68(9.102) | 15.53(2.91) |

| 焦虑自评量表(SAS) | — | 39.31(5.32) |

注:表中括号内数据为标准差;因HAMD-24量表需进行临床医生他评,故对照组未进行测评;抑郁症患者未做SAS量表自评。 |

1.2 数据采集方案

1.3 数据采集设备

1.4 数据校准

1.5 语音转录

2 数据库

表 2 各项生理模态数据统计 |

| 生理模态 | 患者人数 | 对照组人数 | 总计 |

| audio | 41 | 39 | 80 |

| ECG | 46 | 39 | 85 |

| BP | 46 | 40 | 86 |

| BIS | 40 | 40 | 80 |

表 3 任务时长统计 |

| 任务 | 患者 | 对照组 | 总计 | |||

| 男 | 女 | 男 | 女 | |||

| 基线 | 1.90 | 0.50 | 1.20 | 0.80 | 4.40 | |

| TR | 2.60 | 0.69 | 1.83 | 1.15 | 6.27 | |

| PD | 1.85 | 0.48 | 1.89 | 1.29 | 5.51 | |

| 总计 | 6.35 | 1.67 | 4.92 | 3.24 | 16.18 | |

3 数据库多维度分析

3.1 特征提取

表 4 语音特征集 |

| 类别 | 特征 |

| 频率 | 平均基频(mean fundamental frequency F0,mnF0),最小基频(minimum F0,minF0),最大基频(maximum F0,maxF0),基频标准差(standard deviation F0,stdF0),基频抖动(jitter,jtr) |

| 能量 | 振幅抖动(shimmer,shmr),振幅(amplitude,amp),峰值振幅(peak amplitude,pkamp),平均谐噪比(mean HNR,mnHN),最大谐噪比(maximum HNR,maxHN),谐噪比标准差(standard deviation HNR,sdHN) |

| 时域 | 持续时间(duration,dur),峰值时间(peak time,pktime) |

注:谐噪比(harmonic-to-noise ratio,HNR)。 |

表 5 HRV指标 |

| 特征 | 描述 |

| LF | 低频谱功率 |

| HF | 高频谱功率 |

| LF/FH | 低频谱功率与高频谱功率的比值 |

| TP | 总谱功率 |

| ApEn | 利用近似熵估计复杂性 |

| ShanEn | 使用香农熵估计复杂性 |

| FuzzyEn | 改进的熵测量方法 |

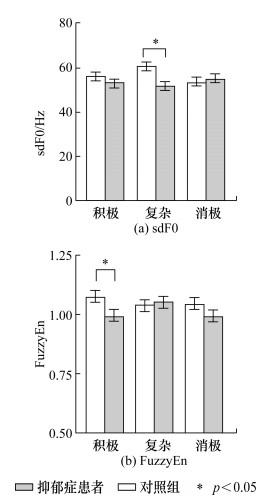

3.2 数据分析

3.3 分析结果

表 6 声学特征与HRV的相关性分析结果 |

| 情绪 | 特征 | LF | HF | TP | ApEn | FuzzyEn |

| 积极 | dur-N | — | 0.389* | — | — | — |

| minF0-N | — | — | — | — | -0.388* | |

| maxHN-N | — | 0.347* | — | — | — | |

| mnHN-N | -0.453* | — | -0.503* | — | — | |

| amp-N | — | — | — | — | 0.375* | |

| amp-D | — | — | — | 0.403* | — | |

| pkamp-N | — | — | — | — | 0.483** | |

| pktime-N | 0.378* | — | — | — | — | |

| pktime-D | — | — | — | 0.562* | — | |

| 复杂 | maxF0-N | — | 0.469* | — | — | — |

| shmr-N | -0.427** | — | — | — | — | |

| amp-D | — | -0.364* | — | 0.386* | — | |

| 消极 | pkamp-D | — | -0.364* | — | — | -0.358* |

| pktime-N | — | — | — | 0.505* | — |

注:—为相关不显著;D为抑郁症患者;N为对照组;*表示p < 0.05; * *表示p < 0.01。 |