1 研究现状与主要问题

1.1 特高拱坝施工隐患分类

1.2 对比学习

1.3 特高拱坝隐患排查线索挖掘

2 研究方法

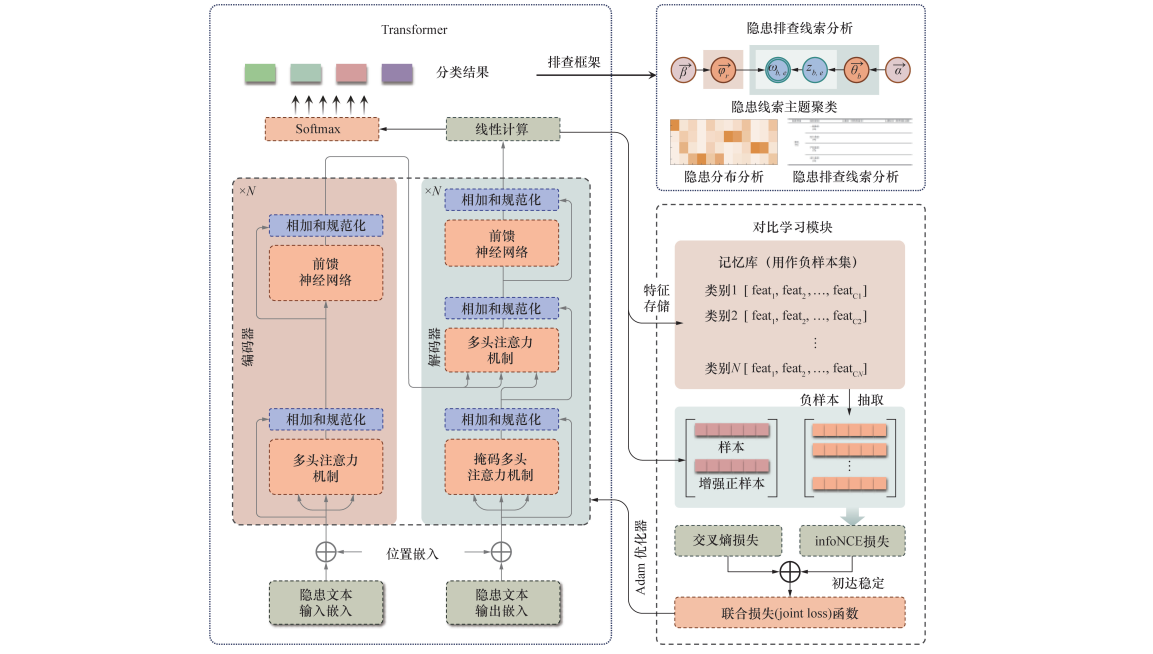

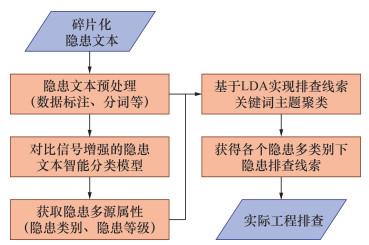

2.1 研究框架

2.2 Transformer模型

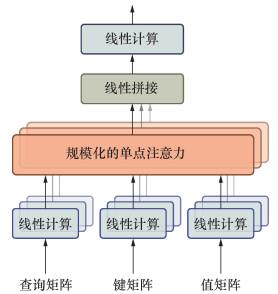

2.2.1 多头注意力机制

2.2.2 编码器和解码器

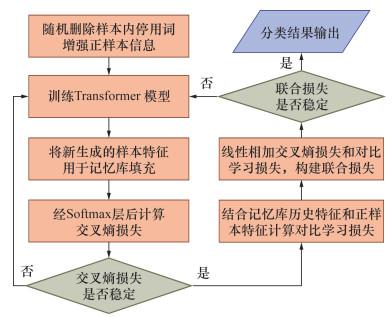

2.3 记忆库改进的半监督对比学习模块

2.3.1 半监督对比学习损失

2.3.2 记忆库

2.3.3 对比学习模块

2.4 记忆库改进的半监督对比学习模块

2.5 基于LDA主题模型的隐患智能排查

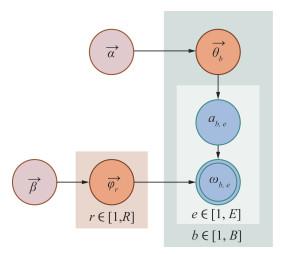

2.5.1 LDA主题模型

2.5.2 隐患排查线索分析流程

3 工程实例

3.1 工程背景及数据来源

表 1 特高拱坝施工安全隐患数据集 |

| 隐患描述 | 隐患类别 | 隐患等级 |

| 电焊机直接放在仓内钢筋上,未绝缘保护 | 触电 | 严重隐患 |

| 风机警戒标志反光锥沾满灰尘倒地,过往车辆易因误视有撞击风机的危险 | 车辆伤害 | 严重隐患 |

| 竖井长期流水,井壁存在坍塌可能。车辆从竖井下部通过存在安全隐患 | 坍塌 | 重大隐患 |

| 六层廊道交通洞废渣堆积,影响人员车辆通行 | 文明施工 | 一般隐患 |

| 3#尾调通气支洞口砂轮机防护罩脱落,存在安全隐患 | 机械伤害 | 严重隐患 |

| 左导2交通洞内变压器旁放置油桶、乙炔瓶,易产生火灾,存在安全隐患 | 火灾 | 较大隐患 |

| 加工车间内,使用安全性能较低的液化气瓶代替乙炔瓶,且未设置回火阀 | 爆炸 | 严重隐患 |

| 左侧岩壁梁排架上一施工人员未戴安全帽 | 三违行为 | 一般隐患 |

| 修复平台后未把剩余钉子清理干净,有从狭缝掉落到尾水伤人危险 | 物体打击 | 严重隐患 |

| 14#引水上平洞内积水严重,水泵出现故障未及时处理,存在安全隐患 | 淹溺 | 一般隐患 |

| 1#场地汽车吊起重作业时,运砖汽车违规进出起吊作业区域 | 起重伤害 | 较大隐患 |

| 左岸水垫塘边坡模板平台防护栏杆倾斜,存在坠落风险 | 高处坠落 | 重大隐患 |

3.2 实验方案与评价指标

表 2 实验参数选择 |

| 参数 | 说明 | 数据集Ⅰ | 数据集Ⅱ | 参数 | 说明 | 数据集Ⅰ | 数据集Ⅱ | |

| embedding_size | 输入向量维度 | 100 | 100 | pad_size | 句长 | 32 | 32 | |

| dropout | 随机失活 | 0.1 | 0.1 | learning_rate | 学习率 | 0.001 | 0.001 | |

| num_encoder | 编码器个数 | 6 | 2 | num_decoder | 解码器个数 | 1 | 1 | |

| num_head | MHA头数量 | 5 | 5 | temperature | 温度系数 | 0.07 | 0.07 | |

| MB_size | 记忆库容量 | 960 | 800 | batch_size | 迭代批容量大小 | 96 | 16 |

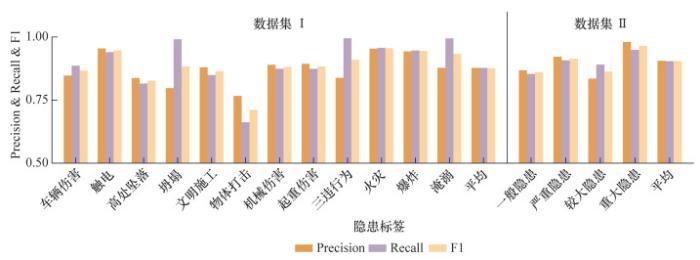

3.3 多分类结果评价

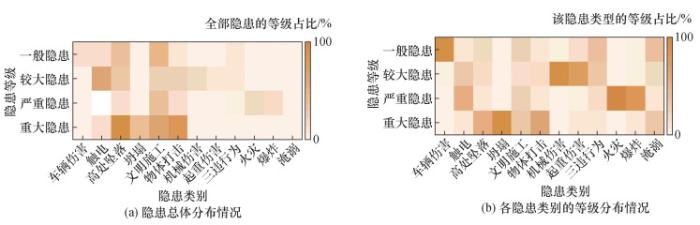

3.4 隐患排查线索分析

表 3 隐患线索排查表 |

| 隐患类别 | 隐患等级 | 主题词(排查线索词) | 主题信息(排查线索主题) |

| 高处坠落 (20.4%) | 一般隐患 (20.5%) | 临边、警戒、警示、缺失、设置、警戒线、损坏、坠落 安全带、未系、作业、作业、绳、施工人员、坠落、佩戴 栏杆、坠落、风险、爬梯、缺失、损坏、通行、发生 排架、坠落、跳板、竹条、绑扎、缺失、封闭、伤害 | 临边警戒缺失风险 工人安全设施缺失 防护栏杆缺失风险 竹条绑扎不足风险 |

| 较大隐患 (18.2%) | 马道、模板、缺失、栏杆、临边、坠落、防护、防护栏 破损、吊车、吊篮、作业、危险、防护、工人、措施 坝肩、水垫塘、高空作业、坠落、安全带、母线洞、备仓施工、高处 平台、堵头、封闭、模板、安全、跟进、防护、隐患 | 马道防护缺失风险 吊车吊篮危险作业 工人高空作业风险 堵头暂未封闭风险 | |

| 严重隐患 (9.1%) | 发生、作业、排架、坠落、操作、易、搭设、风险 尾水、尾水洞、吊篮、防护、连接管、不足、块石、调压 临边、隐患、护栏、水垫塘、大盘、伤害、缺失、坠落 盖板、孔洞、警示、坠落、过大、跳板、坠落、风险 | 排架作业坠落风险 尾水防护缺失风险 临边防护缺失风险 孔洞防护缺失风险 | |

| 重大隐患 (52.2%) | 台车、坠落、栏杆、高空、风险、马道、临边、变形 夹板、坠落、踏翻、断裂、水垫塘、风险、马道、施工现场 安全防护网、振捣、倾翻、平台、坝肩、马脖子、进水塔 竖井、临边、井口、井盖、损坏、变形、坠落、警示 | 台车高空坠落风险 夹板破损坠落风险 振捣平台倾翻风险 竖井变形坠落风险 |

注:隐患类别中百分数为该隐患类别占总体隐患的比例,隐患等级中百分数为对应隐患类别下各等级隐患发生比例。 |

4 讨论

4.1 参数分析与消融实验

表 4 数据集Ⅰ记忆库大小对比 |

| MB_size | Precision | Recall | F1 |

| 192 | 0.868 3 | 0.865 9 | 0.864 1 |

| 480 | 0.871 1 | 0.869 3 | 0.867 7 |

| 960 | 0.877 4 | 0.877 6 | 0.875 9 |

| 1 920 | 0.872 0 | 0.869 3 | 0.867 0 |

| 4 800 | 0.876 2 | 0.874 6 | 0.873 0 |

表 5 数据集Ⅱ记忆库大小对比 |

| MB_size | Precision | Recall | F1 |

| 80 | 0.886 7 | 0.881 1 | 0.882 0 |

| 160 | 0.895 2 | 0.892 6 | 0.893 5 |

| 400 | 0.898 3 | 0.888 3 | 0.890 0 |

| 800 | 0.905 6 | 0.904 0 | 0.904 5 |

| 1 600 | 0.895 5 | 0.894 0 | 0.894 6 |

表 6 消融实验 |

| 模型名称 | 数据集Ⅰ | 数据集Ⅱ | |||||

| Precision | Recall | F1 | Precision | Recall | F1 | ||

| Trm+MB+CL+SE | 0.877 4 | 0.877 6 | 0.875 9 | 0.905 6 | 0.904 0 | 0.904 5 | |

| Trm+CL+SE | 0.870 6 | 0.867 1 | 0.866 0 | 0.897 5 | 0.895 4 | 0.896 2 | |

| Trm+CL | 0.837 9 | 0.835 7 | 0.835 5 | 0.882 3 | 0.882 5 | 0.882 3 | |

| Trm+SE | 0.850 9 | 0.845 7 | 0.845 9 | 0.880 7 | 0.881 1 | 0.880 4 | |

| Trm | 0.839 1 | 0.836 4 | 0.834 8 | 0.875 5 | 0.875 4 | 0.875 2 | |

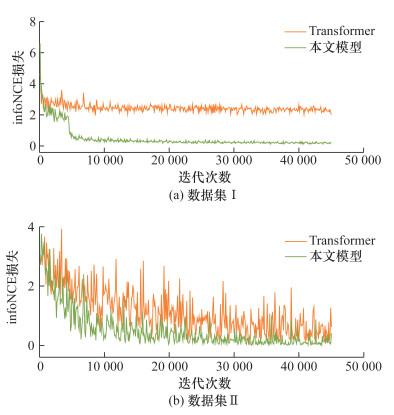

4.2 对比学习模块有效性分析

4.3 模型间效果对比

表 7 模型间分类效果对比 |

| 模型名称 | 数据集Ⅰ | 数据集Ⅱ | |||||

| Precision | Recall | F1 | Precision | Recall | F1 | ||

| 本文模型 | 0.877 4 | 0.877 6 | 0.875 9 | 0.905 6 | 0.904 0 | 0.904 5 | |

| BERT | 0.863 5 | 0.862 7 | 0.861 2 | 0.892 6 | 0.887 4 | 0.887 4 | |

| RCNN | 0.835 7 | 0.847 5 | 0.833 0 | 0.876 7 | 0.872 5 | 0.874 1 | |

| BiLSTM | 0.835 6 | 0.834 5 | 0.832 3 | 0.880 5 | 0.871 1 | 0.872 2 | |

| CNN | 0.821 0 | 0.812 3 | 0.810 1 | 0.877 6 | 0.876 8 | 0.876 8 | |

| RNN | 0.817 9 | 0.830 9 | 0.814 8 | 0.878 7 | 0.873 9 | 0.875 2 | |

| FastText | 0.783 7 | 0.774 1 | 0.771 4 | 0.800 5 | 0.802 3 | 0.797 6 | |