1 相关工作

1.1 关系抽取

1.2 持续学习

1.3 对比学习

2 方法

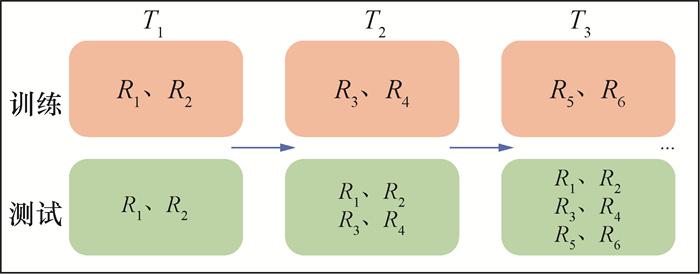

2.1 任务描述

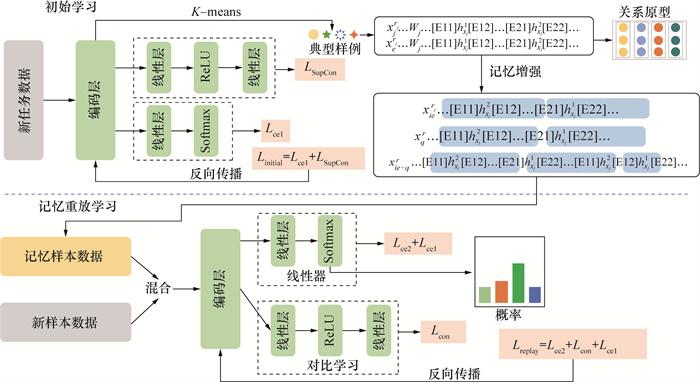

2.2 模型整体框架

2.3 初始学习

2.3.1 记忆样本选取策略

2.3.2 记忆增强策略

2.4 记忆重放学习

2.4.1 关系预测

3 实验

3.1 环境设置

3.2 评价指标

3.3 数据集

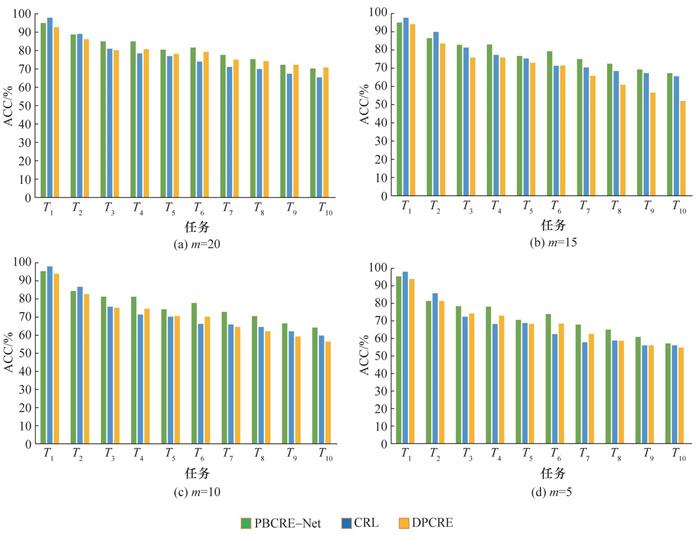

3.4 实验结果与分析

表 1 在CMeIE数据集上不同模型的ACC |

| 模型 | T1 | T2 | T3 | T4 | T5 | T6 | T7 | T8 | T9 | T10 |

| CRECL | 97.00 | 88.12 | 72.47 | 68.79 | 58.46 | 57.09 | 47.99 | 47.91 | 44.10 | 38.62 |

| EMAR(BERT) | 96.89 | 85.36 | 80.39 | 81.04 | 71.70 | 73.62 | 68.78 | 64.84 | 61.59 | 59.33 |

| EMAR(BERT)+ACA | 97.25 | 82.91 | 78.96 | 80.49 | 70.47 | 74.58 | 68.63 | 66.06 | 61.37 | 61.72 |

| PRCRE | 97.70 | 83.99 | 65.91 | 62.93 | 63.78 | 58.24 | 60.45 | 58.40 | 57.18 | 55.31 |

| PRCRE+ACA | 97.24 | 83.31 | 74.07 | 76.88 | 71.47 | 57.02 | 61.65 | 57.79 | 56.39 | 59.09 |

| CRL | 97.87 | 88.11 | 80.99 | 78.63 | 77.14 | 73.86 | 71.24 | 70.00 | 67.34 | 65.53 |

| DPCRE | 92.69 | 86.17 | 80.09 | 80.82 | 78.24 | 79.22 | 74.97 | 74.25 | 72.22 | 70.96 |

| PBCRE-Net | 95.02 | 88.59 | 84.93 | 84.90 | 80.35 | 81.65 | 77.58 | 75.26 | 72.22 | 70.15 |

表 2 在CMeIE数据集上不同模型的Macro-F1 |

| 模型 | T1 | T2 | T3 | T4 | T5 | T6 | T7 | T8 | T9 | T10 |

| CRECL | 96.90 | 87.22 | 71.57 | 66.89 | 59.06 | 56.89 | 48.99 | 47.91 | 45.10 | 39.52 |

| EMAR(BERT) | 96.79 | 84.86 | 81.49 | 80.84 | 73.10 | 72.72 | 68.68 | 63.44 | 61.79 | 59.63 |

| EMAR(BERT)+ACA | 96.35 | 84.01 | 77.96 | 76.39 | 72.06 | 71.28 | 66.67 | 64.86 | 63.47 | 62.52 |

| PRCRE | 96.04 | 83.79 | 84.84 | 75.71 | 75.65 | 70.85 | 65.60 | 59.21 | 58.68 | 53.31 |

| PRCRE+ACA | 97.14 | 82.21 | 74.97 | 74.78 | 69.47 | 65.02 | 61.85 | 60.79 | 59.49 | 58.09 |

| CRL | 97.15 | 86.26 | 82.99 | 79.13 | 76.61 | 73.55 | 70.14 | 67.87 | 65.55 | 63.58 |

| DPCRE | 90.19 | 85.76 | 79.00 | 75.83 | 66.92 | 64.78 | 61.46 | 60.87 | 59.87 | 55.42 |

| PBCRE-Net | 94.27 | 88.31 | 82.98 | 81.93 | 76.79 | 78.15 | 71.60 | 69.70 | 67.08 | 66.13 |

3.5 消融实验

表 3 消融实验ACC |

| 模型 | T1 | T2 | T3 | T4 | T5 | T6 | T7 | T8 | T9 | T10 |

| PBCRE-Net | 95.02 | 88.59 | 84.93 | 84.9 | 80.35 | 81.65 | 77.58 | 75.26 | 72.52 | 70.25 |

| w/o aug | 95.02 | 87.22 | 84.03 | 83.46 | 78.10 | 80.07 | 75.59 | 73.38 | 70.66 | 68.39 |

| w/o con_loss | 95.45 | 87.93 | 84.48 | 84.20 | 78.79 | 80.69 | 77.06 | 75.13 | 72.46 | 70.03 |

| w/o diss_loss | 95.53 | 87.69 | 83.89 | 83.71 | 77.62 | 80.15 | 76.85 | 74.85 | 71.35 | 69.11 |

表 4 单一数据集上在不同记忆样本内存情况下PBCRE-Net的ACC |

| 模型 | T1 | T2 | T3 | T4 | T5 | T6 | T7 | T8 | T9 | T10 |

| 20 | 95.02 | 88.59 | 84.93 | 84.90 | 80.35 | 81.65 | 77.58 | 75.26 | 72.22 | 70.15 |

| 15 | 95.31 | 86.53 | 82.80 | 82.98 | 76.83 | 79.34 | 75.04 | 72.55 | 69.30 | 67.40 |

| 10 | 95.36 | 84.21 | 81.27 | 81.18 | 74.36 | 77.61 | 72.93 | 70.55 | 66.61 | 64.25 |

| 5 | 95.37 | 81.38 | 78.91 | 77.97 | 70.53 | 73.82 | 67.67 | 64.66 | 60.66 | 57.03 |

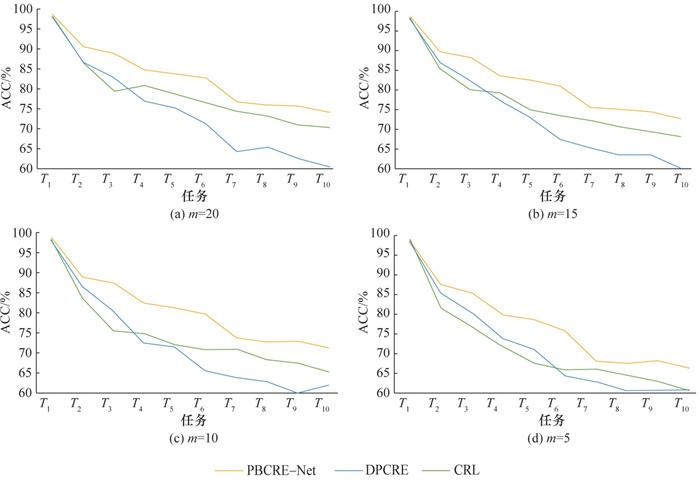

3.6 跨领域扩展实验分析

表 5 跨领域数据集上不同模型的ACC |

| 模型 | T1 | T2 | T3 | T4 | T5 | T6 | T7 | T8 | T9 | T10 |

| CRECL | 98.32 | 91.53 | 71.21 | 69.42 | 60.26 | 57.31 | 45.24 | 39.70 | 36.81 | 39.29 |

| PRCRE | 98.45 | 78.38 | 75.55 | 58.68 | 50.59 | 39.28 | 38.84 | 40.76 | 34.79 | 39.11 |

| PRCRE+ACA | 98.50 | 76.44 | 64.39 | 54.53 | 44.13 | 41.35 | 36.57 | 29.43 | 32.60 | 38.53 |

| EMAR(BERT) | 98.50 | 87.60 | 82.55 | 75.17 | 72.63 | 69.31 | 63.56 | 63.25 | 62.03 | 59.34 |

| EMAR(BERT)+ACA | 97.78 | 86.34 | 84.00 | 75.87 | 72.95 | 70.02 | 64.84 | 65.40 | 60.85 | 59.75 |

| DRCRE | 97.98 | 86.72 | 82.71 | 76.89 | 75.29 | 71.33 | 64.27 | 65.43 | 62.58 | 60.47 |

| CRL | 98.64 | 86.37 | 79.42 | 80.87 | 78.53 | 76.46 | 74.39 | 73.19 | 71.00 | 70.35 |

| PBCRE-Net | 98.61 | 90.54 | 88.81 | 84.84 | 83.88 | 82.76 | 76.85 | 75.99 | 75.73 | 74.16 |

表 6 跨领域数据集上不同模型的Macro-F1 |

| 模型 | T1 | T2 | T3 | T4 | T5 | T6 | T7 | T8 | T9 | T10 |

| CRECL | 88.32 | 81.63 | 70.81 | 65.52 | 66.96 | 56.91 | 43.44 | 36.70 | 35.71 | 37.69 |

| PRCRE | 89.45 | 79.08 | 68.65 | 56.88 | 51.09 | 42.78 | 39.84 | 39.86 | 34.39 | 38.21 |

| PRCRE+ACA | 79.50 | 80.44 | 73.02 | 60.63 | 55.93 | 43.55 | 37.67 | 35.43 | 36.06 | 36.53 |

| EMAR(BERT) | 92.50 | 83.68 | 79.65 | 74.67 | 72.33 | 67.51 | 64.66 | 63.25 | 62.03 | 57.88 |

| EMAR(BERT)+ACA | 90.78 | 81.34 | 79.60 | 74.97 | 71.99 | 69.52 | 66.34 | 65.40 | 60.85 | 58.65 |

| DRCRE | 91.88 | 84.72 | 81.01 | 76.95 | 74.99 | 72.33 | 66.87 | 65.43 | 62.58 | 64.77 |

| CRL | 92.64 | 85.37 | 81.52 | 80.67 | 76.63 | 74.96 | 69.59 | 73.19 | 71.00 | 66.65 |

| PBCRE-Net | 92.60 | 88.54 | 86.81 | 84.84 | 79.88 | 76.76 | 74.90 | 73.31 | 72.14 | 69.34 |

表 7 混合数据集上在不同记忆内存情况下PBCRE-Net的ACC |

| m | T1 | T2 | T3 | T4 | T5 | T6 | T7 | T8 | T9 | T10 |

| 20 | 95.11 | 88.63 | 85.12 | 85.11 | 81.25 | 82.24 | 77.53 | 75.88 | 73.11 | 70.86 |

| 15 | 95.10 | 87.66 | 81.96 | 82.24 | 77.63 | 79.32 | 74.68 | 72.26 | 69.66 | 68.36 |

| 10 | 94.43 | 84.69 | 82.44 | 82.36 | 75.34 | 78.81 | 73.82 | 71.70 | 68.96 | 65.31 |

| 5 | 94.31 | 81.63 | 78.76 | 78.68 | 71.52 | 73.67 | 68.02 | 65.41 | 61.83 | 58.22 |