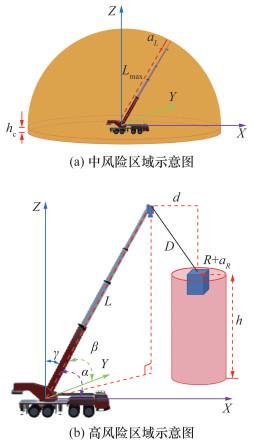

为有效预防事故,施工过程中可以通过监测起重机的运行数据及工人的位置,及早识别安全风险并及时发出预警

[5-7]。信息技术在起重机安全风险监测中发挥了重要作用。例如,在起重机监测方面,Kan等

[8]基于信息物理技术构建了起重机与其虚拟模型之间的双向通信与协调机制,借助传感器技术感知周围环境,并利用数据分析识别潜在安全隐患,从而对起重机进行实时反馈控制。在吊物与工人检测方面,Price等

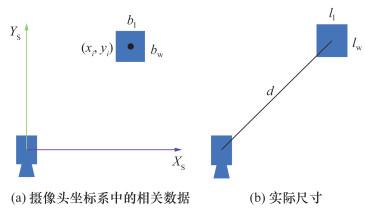

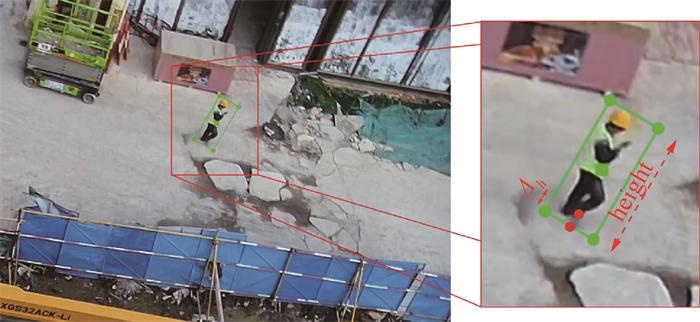

[9]基于计算机视觉技术,通过负载摆动和旋转估计、工人检测和跟踪以及工作区动态更新,实现了起重机工作空间的动态更新,从而避免盲吊作业过程中的碰撞;张燕超等

[10]采用YOLOv8算法对工人和吊物进行目标识别,并利用双目立体定位技术确认目标的位置和形状信息,实现了实时监测工人是否进入起重机的危险区域;Chian等

[11]通过CenterNet等计算机视觉方法动态检测起重机负载在地面的投影,并结合工人检测,实现了工人进入危险区域的自动识别;Yang等

[12]利用掩码区域卷积神经网络(mask region-based convolutional neural network,Mask R-CNN)识别工人、危险区域和塔吊吊钩的像素坐标,并将其转换为实际的安全距离;Zhang等

[13]通过FairMOT模型对工人和吊物进行跟踪,获取其形状、位置、速度和历史轨迹信息,并结合Transformer模型预测对象轨迹,从而提前识别工人和吊物间的不安全接近情况。