1 数据集制备与再划分

1.1 数据集构建

1.2 数据集再划分

表 1 验证集子数据集特征信息 |

| 互斥环境条件组 | 数据比例 |

| 不良照度-适宜照度 | 238张(30.6%)∶540张(69.4%) |

| 航拍视角-地面视角 | 86张(11.1%)∶692张(88.9%) |

| 室内环境-室外环境 | 22张(2.8%)∶756张(97.2%) |

| 林草火灾-其他火灾 | 373张(47.9%)∶405张(52.1%) |

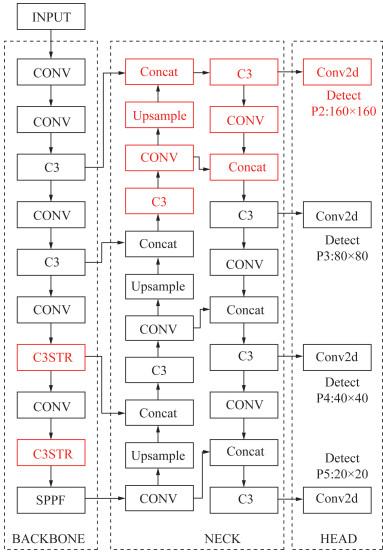

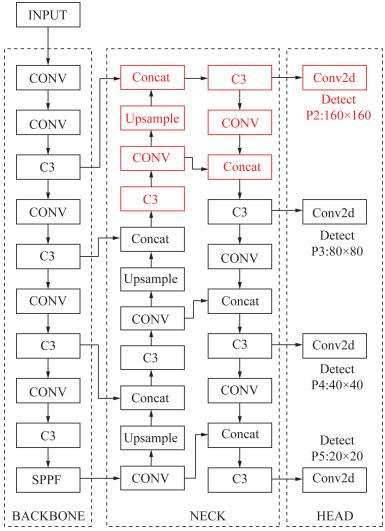

2 YOLOv5s-SSS模型

2.1 模型概述

2.2 拓展多尺度检测层

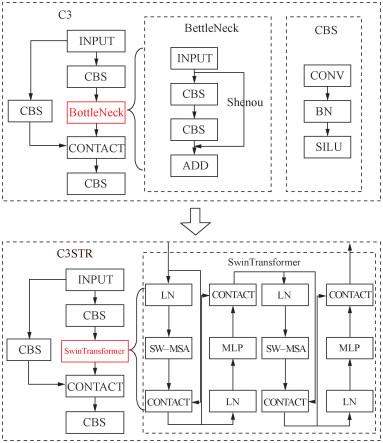

2.3 嵌入swin transformer模块

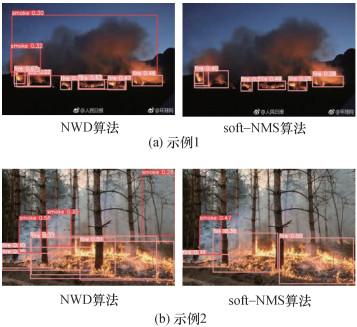

2.4 优化后处理函数

3 实验与验证

3.1 实验环境配置

表 2 代码运行参数配置 |

| 参数名称 | 实验配置 |

| 初始学习率 | 0.01 |

| 迭代次数 | 300次 |

| 批次大小 | 4张 |

| 优化器 | SGD |

| 无增长提前终止轮数 | 100轮 |

| 网络输入尺寸 | 640像素×640像素 |

3.2 评价指标

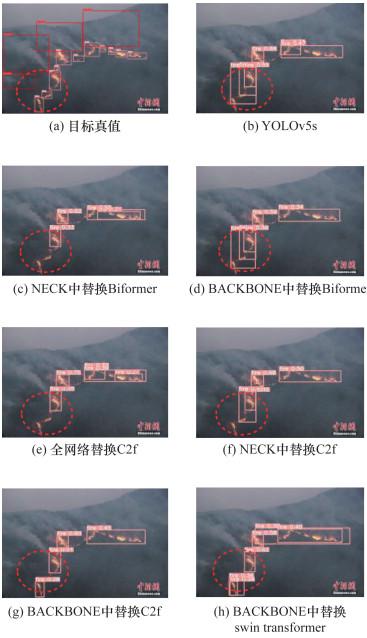

3.3 消融实验

表 3 检测层消融实验结果 |

| 实验方案 | AP1(烟雾) | AP2(火焰) | mAP |

| YOLOv5s | 0.343 | 0.186 | 0.264 |

| YOLOv5s+P2检测头 | 0.325 | 0.189 | 0.257 |

表 4 模块消融实验结果 |

| 实验方案 | AP1(烟雾) | AP2(火焰) | mAP |

| YOLOv5s | 0.343 | 0.186 | 0.264 |

| 在特征融合网络(NECK)中替换Biformer [17] | 0.352 | 0.170 | 0.261 |

| 在骨干网络(BACKBONE)中替换Biformer [17] | 0.313 | 0.171 | 0.242 |

| 在全网络替换C2f [18] | 0.336 | 0.180 | 0.258 |

| 在特征融合网络(NECK)中替换C2f [18] | 0.354 | 0.176 | 0.265 |

| 在骨干网络(BACKBONE)中替换C2f [18] | 0.334 | 0.184 | 0.259 |

| 在骨干网络(BACKBONE)中替换swin transformer[15] | 0.341 | 0.209 | 0.275 |

表 6 整体改进消融实验结果 |

| 实验方案 | AP1(烟雾) | AP2(火焰) | mAP |

| YOLOv5s(无改进) | 0.343 | 0.186 | 0.264 |

| YOLOv5s+改进a | 0.325 | 0.189 | 0.257 |

| YOLOv5s+改进a+改进b | 0.321 | 0.208 | 0.264 |

| YOLOv5s+改进a+改进b+改进c(YOLOv5s-SSS) | 0.403 | 0.339 | 0.371 |

3.4 YOLOv5s-SSS模型性能实验

表 7 参数调优实验结果 |

| iou阈值 | 测试模型 | AP1(烟雾) | AP2(火焰) | mAP |

| 0.60 | YOLOv5s | 0.343 | 0.186 | 0.264 |

| YOLOv5s-SSS | 0.403 | 0.339 | 0.371 | |

| 0.40 | YOLOv5s | 0.352 | 0.227 | 0.290 |

| YOLOv5s-SSS | 0.402 | 0.346 | 0.374 | |

| 0.30 | YOLOv5s | 0.340 | 0.240 | 0.290 |

| YOLOv5s-SSS | 0.402 | 0.346 | 0.374 | |

| 0.20 | YOLOv5s | 0.320 | 0.247 | 0.283 |

| YOLOv5s-SSS | 0.402 | 0.349 | 0.376 | |

| 0.10 | YOLOv5s | 0.309 | 0.248 | 0.278 |

| YOLOv5s-SSS | 0.402 | 0.349 | 0.376 | |

| 0.05 | YOLOv5s | 0.307 | 0.249 | 0.278 |

| YOLOv5s-SSS | 0.402 | 0.349 | 0.376 |

表 8 互斥环境条件对比实验结果 |

| 组别设置 | 子数据集名称 | AP1(烟雾) | AP2(火焰) | mAP |

| 实验组一 | 不良照度 | 0.419 | 0.317 | 0.368 |

| 适宜照度 | 0.411 | 0.355 | 0.383 | |

| 实验组二 | 航拍视角 | 0.401 | 0.391 | 0.396 |

| 地面视角 | 0.403 | 0.336 | 0.370 | |

| 实验组三 | 室内环境 | 0 | 0.400 | 0.200 |

| 室外环境 | 0.401 | 0.338 | 0.369 | |

| 实验组四 | 林草火灾 | 0.368 | 0.344 | 0.356 |

| 非林草火灾 | 0.434 | 0.336 | 0.385 | |

| 对照组 | 基线数据集 | 0.403 | 0.339 | 0.371 |

注:基线数据集为1.2节中构建的完整的小目标火焰图像数据集。 |

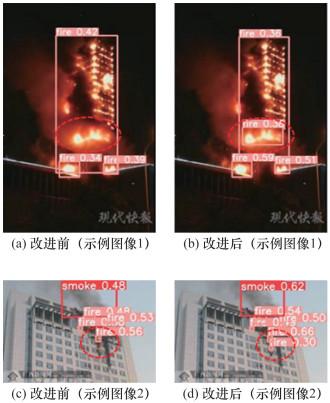

3.5 可视化验证

表 9 可视化评价结果 |

| 工作条件 | 模型种类 | |||

| YOLOv5s | YOLOv5s+改进a | YOLOv5s+改进a+改进b | YOLOv5s+改进a+改进b+改进c | |

| 1-适宜照度的林草火灾 |  |  |  |  |

| 2-不良照度的非林草火灾 |  |  |  |  |

| 3-航拍视角的林草火灾 |  |  |  |  |

| 4-不良照度的室内火灾 |  |  |  |  |

注:fire 0.39表示模型预测该目标为“火焰”的置信度为0.39,smoke 0.30表示模型预测该目标为“烟雾”的置信度为0.30,依此类推。拓展多尺度检测层简称为改进a、嵌入swin transformer模块简称为改进b、优化后处理函数简称为改进c。 |