与传统图像数字处理相比,深度学习算法能自动适应复杂裂缝,避免了手工设计特征提取器,是计算机视觉的核心

[8]。裂缝识别定位算法分为2类:基于区域卷积神经网络(region-based convolutional neural network,R-CNN)的两阶段算法,如Fast R-CNN、Faster R-CNN和Mask R-CNN等,通过区域网络生成目标候选区域,进行裂缝的分类和边界框回归,输出裂缝的类别和准确位置

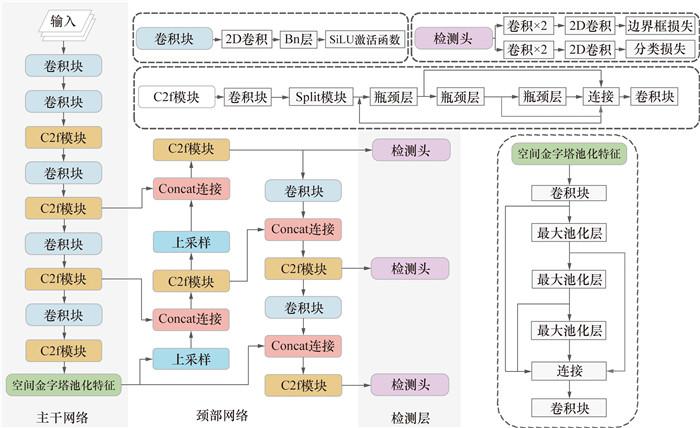

[9];基于你只看一次(You Only Look Once,YOLO)的单阶段算法,如YOLOv1至YOLOv8等版本,通过放弃区域提取步骤,将检测任务作为回归问题解决,直接获得图像中裂缝的位置和类别信息,提高裂缝识别效率,已广泛应用于裂缝识别领域

[10]。Yu等

[11]针对无人机无法实时监测桥梁裂缝的问题,提出了融合焦点损失和剪枝模型(focal loss and pruning model,FLPM)损失函数的YOLOv4-FPM深度学习模型,可在提高模型精度的同时降低模型大小和参数量,不仅能实时处理图像,还能识别不同尺寸的桥梁裂缝。Kumar等

[12]提出一种基于边缘算法的YOLOv3模型,并部署在六轴无人机上,解决了超高层建筑损伤的实时识别问题,实现了超高层建筑外表面损伤的实时健康监测。Yang等

[13]用W-PAN网络替换YOLOv5主干网络,通过GhostC3和ShuffleConv模块优化原有网络的C3和Conv模块,提高了沥青路面非变形病害检测的精度和速度。Teng等

[14]基于YOLOv3深度学习算法,通过引入迁移学习模型和数据增强技术,提高模型的特征提取性能和鲁棒性,实现了桥梁表面裂缝和钢筋裸露在不同图像分辨率下的精确高效识别。Wu等

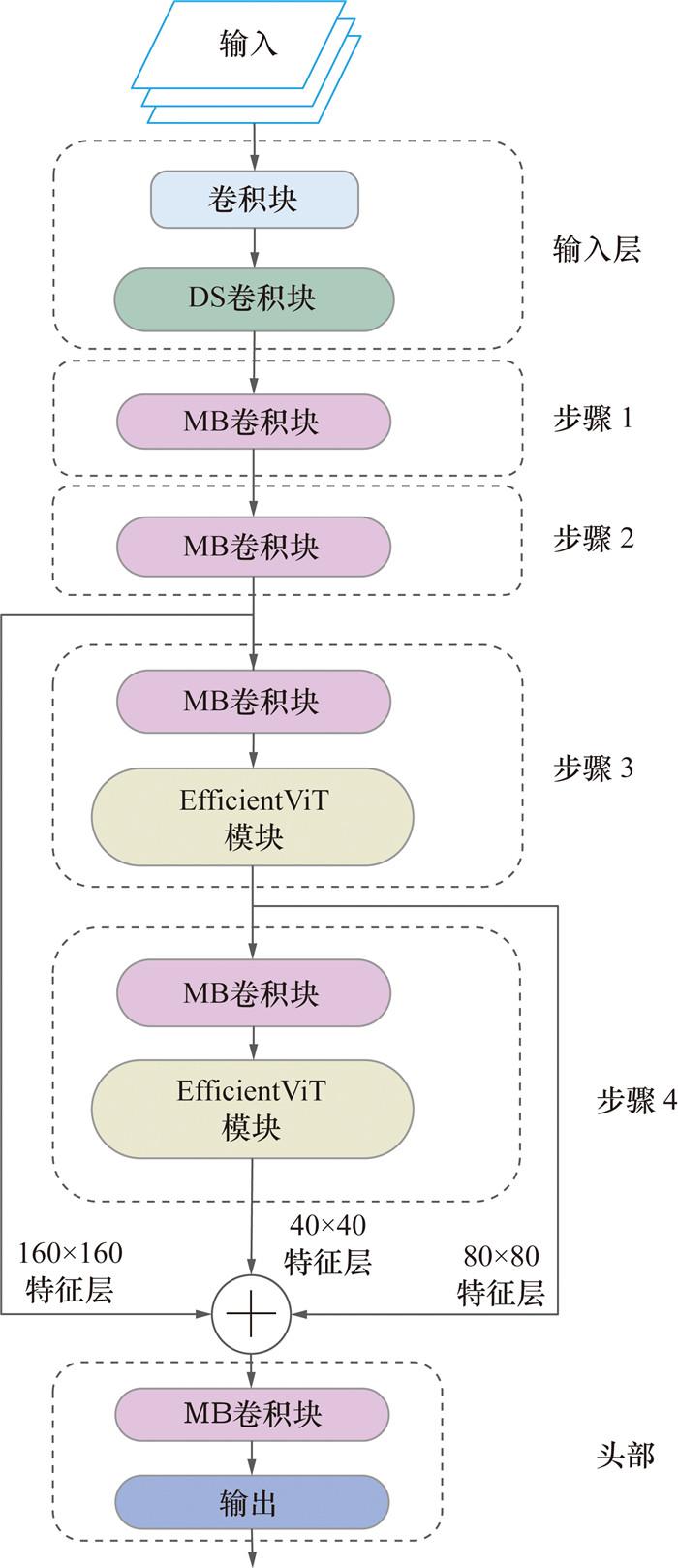

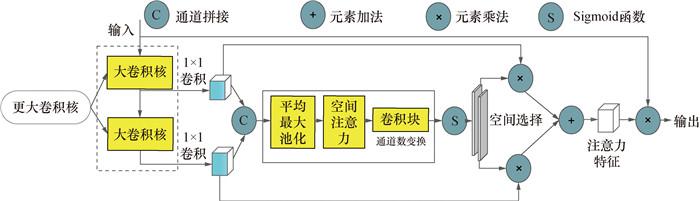

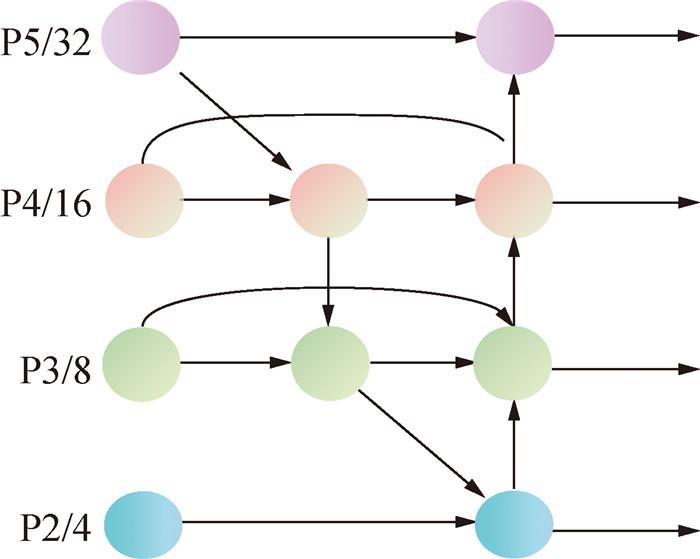

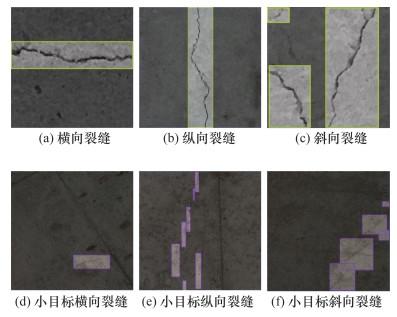

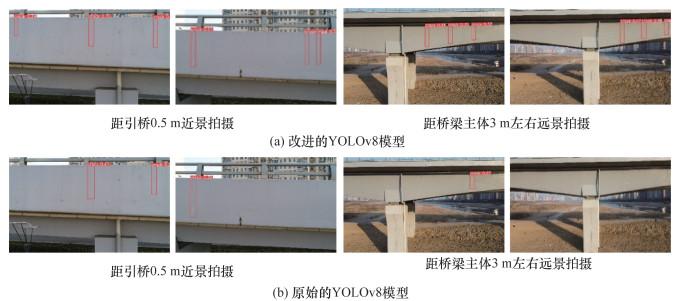

[15]提出了一种改进的YOLOv8深度学习模型,该模型结合了轻量级主干网络和高效的原型掩膜分支,降低了模型的复杂度,并保持模型的精度不变,完成了对大坝和桥梁结构裂缝的实时像素级检测。有关学者已对YOLO算法进行了改进,结合无人机数据采集,满足了算法轻量化、准确率提升、复杂环境裂缝识别、实时处理的需求。无人机安全距离的限制和裂缝过小导致桥梁裂缝检测过程中的小目标特征信息提取困难,进而导致小目标裂缝被误检漏检,这为桥梁运营带来巨大的安全隐患。因此,需要一种算法对桥梁中的小目标裂缝进行准确识别。