然而,传统启发式方法面临灵活性不足、局部最优等问题。DRL因能灵活应对动态大规模问题而受到青睐。在研究云计算的工作中,Li等

[19]提出深度Q网络(deep Q-network,DQN)引导的自适应部署策略,但动作空间受限;Wang等

[20]通过DRL定位SFC部署,侧重容错而忽略VNF的具体位置;Gu等

[21]借助深度确定性策略梯度(deep deterministic policy gradient,DDPG)增强调度能力,但基于的理想化假设限制了实际应用;Pei等

[22]利用双深度Q网络(double deep Q-network,DDQN)求解VNF部署,同样依赖于流量预测;邱航等

[23]的DQN方法虽关注资源消耗与时延约束,但未有效约束动作空间,影响算法训练效率。在研究边缘计算的工作中,Khoshkholghi等

[24]利用分布式DRL实现边缘环境负载均衡;Lü等

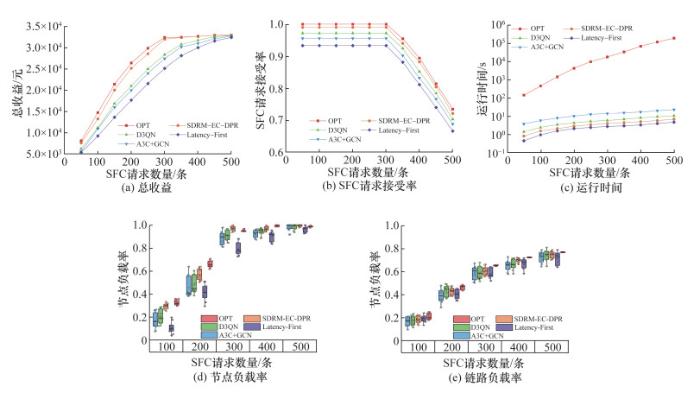

[25]采用D3QN的联合调度策略,旨在增加服务商收益并优化边缘计算资源利用;Chai等

[26]面对卫星通信资源紧缺,设计了联合多任务方案以提升卫星物联网的承载效率;Li等

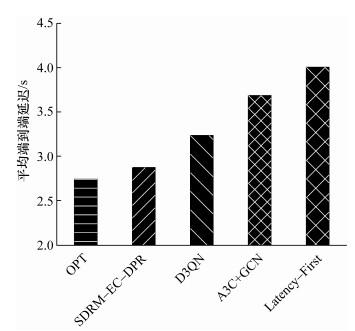

[27]通过并行服务加速在线服务计算,缩短SFC处理时间和延迟,增强资源利用率;Sun等

[28]聚焦实时图任务调度,利用迭代算法减小有向无环图宽度并满足截止时间;Tang等

[29]建立了双时间尺度框架模型,用于卫星边缘计算网络的服务部署和任务调度,确保计算性能与服务质量(quality of service,QoS);Yu等

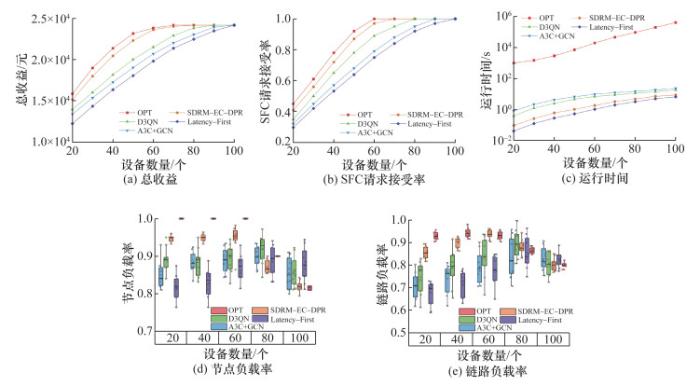

[30]综合优化了服务延迟、部署成本和请求接受率,以达到多样化的QoS需求;Guo等

[31]通过SFC请求并行处理和VNF独立激活,减少SFC长度,实现计算加速。