1 相关工作

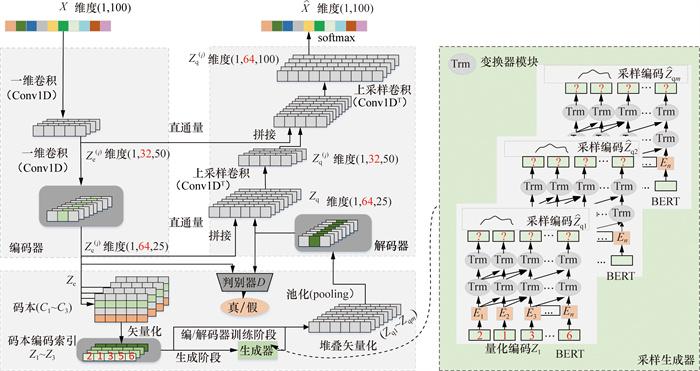

2 基于残差网络的矢量量化堆叠自编码器

2.1 编码器模块

2.2 堆叠矢量量化模块

2.3 解码器模块

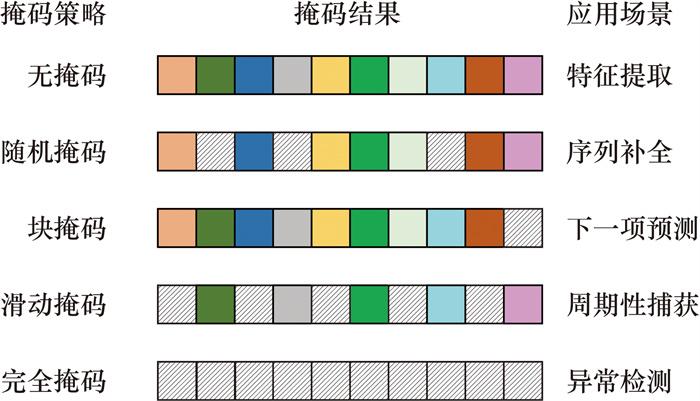

2.4 采样生成器模块

3 模型训练

3.1 重构损失

3.2 量化损失

3.3 对抗性损失

3.4 总损失

4 实验结果及分析

4.1 实验数据集

表 1 数据集概要统计信息 |

| 数据集 | 用户数 | 物品数 | 交互数 |

| ML-1M | 6 040 | 3 706 | 1 000 209 |

| Retail Rocket | 1 407 580 | 235 061 | 2 756 101 |

4.2 评价指标

4.3 基线模型及实验设置

4.4 总体性能比较

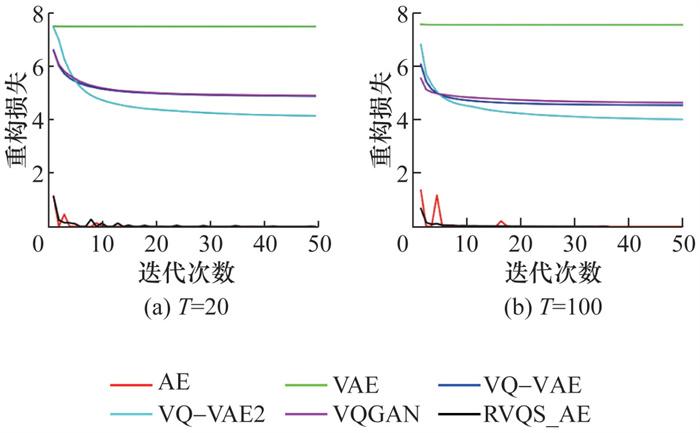

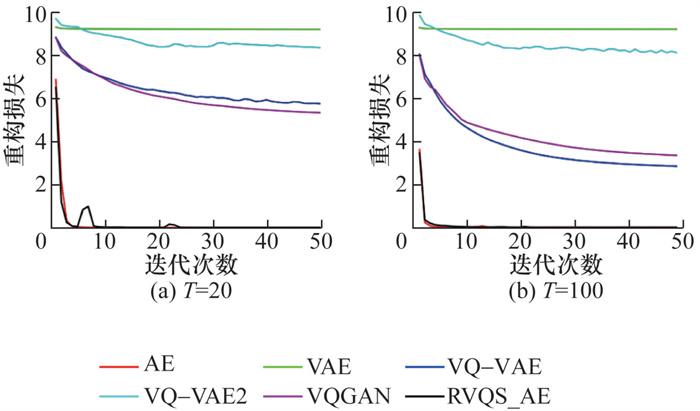

4.4.1 重构能力分析

表 2 模型重构性能总览 |

| 数据集 | T | 重构损失 | 准确率/% | |||||||||||

| AE | VAE | VQ-VAE | VQ-VAE2 | VQGAN | RVQS_AE | AE | VAE | VQ-VAE | VQ-VAE2 | VQGAN | RVQS_AE | |||

| ML-1M | 20 | 3.14×10-7 | 7.511 | 4.902 | 4.159 | 4.918 | 0.151 2 | 0.998 | 0.002 7 | 0.042 | 0.496 | 0.056 | 0.706 9 | |

| 100 | 4.84×10-6 | 7.581 | 4.560 | 4.026 | 4.677 | 0.003 9 | 0.989 | 0.001 9 | 0.042 | 0.041 | 0.008 | 0.505 8 | ||

| Retail | 20 | 1.88×10-5 | 9.219 | 5.754 | 8.368 | 5.336 | 0.000 2 | 0.974 | 0.002 9 | 0.051 | 0.031 | 0.054 | 0.812 6 | |

| Rocket | 100 | 3.55×10-7 | 9.006 | 2.774 | 7.927 | 3.271 | 0.001 9 | 0.965 | 0.002 6 | 0.045 | 0.032 | 0.062 | 0.742 1 | |

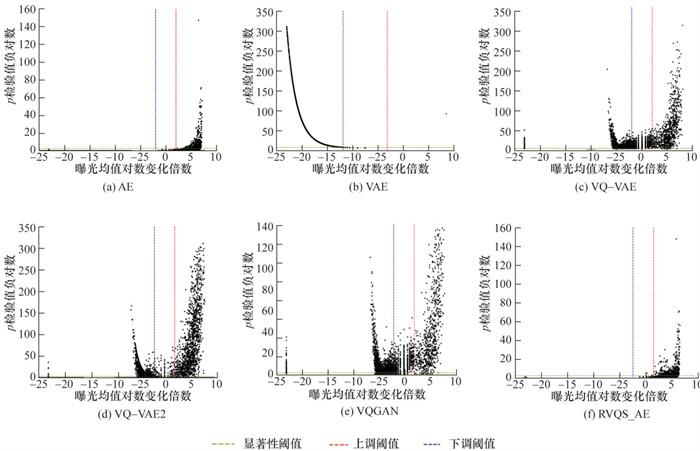

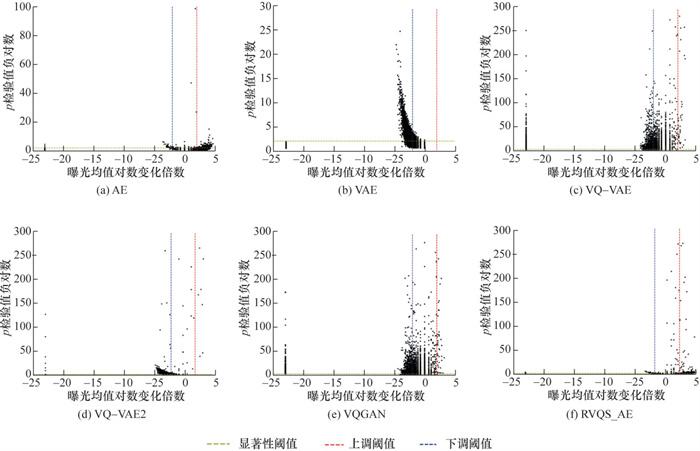

4.4.2 生成能力分析

4.5 超参数分析

表 3 ML-1M数据集上的超参数实验 |

| m | T | 重构损失 | 准确率/% |

| 1 | 20 | 0.184 9 | 0.651 1 |

| 100 | 0.045 2 | 0.480 3 | |

| 2 | 20 | 0.184 2 | 0.652 3 |

| 100 | 0.043 1 | 0.485 2 | |

| 3 | 20 | 0.172 8 | 0.690 2 |

| 100 | 0.041 5 | 0.498 5 | |

| 4 | 20 | 0.151 2 | 0.706 9 |

| 100 | 0.003 9 | 0.505 8 | |

| 5 | 20 | 0.162 3 | 0.695 1 |

| 100 | 0.040 9 | 0.501 2 |

表 4 RetailRocket数据集上的超参数实验 |

| m | T | 重构损失 | 准确率/% |

| 1 | 20 | 2.92×10-4 | 0.762 1 |

| 100 | 4.25×10-5 | 0.722 1 | |

| 2 | 20 | 2.64×10-4 | 0.798 4 |

| 100 | 4.12×10-5 | 0.732 1 | |

| 3 | 20 | 2.42×10-4 | 0.812 6 |

| 100 | 3.94×10-5 | 0.742 1 | |

| 4 | 20 | 2.99×10-4 | 0.775 4 |

| 100 | 4.14×10-4 | 0.712 1 | |

| 5 | 20 | 2.96×10-4 | 0.751 9 |

| 100 | 3.01×10-4 | 0.651 4 |

4.6 消融实验分析

表 5 消融实验结果 |

| 数据集 | 模型 | T | 重构损失 | 准确率/% |

| ML-1M | NoRest-Stack | 20 | 5.028 | 0.416 0 |

| 100 | 5.021 | 0.402 1 | ||

| Rest-NoStack | 20 | 0.184 | 0.651 1 | |

| 100 | 0.045 | 0.480 3 | ||

| NoAdv-Stack | 20 | 0.190 | 0.645 1 | |

| 100 | 0.048 | 0.475 5 | ||

| Retail Rocket | NoRest-Stack | 20 | 5.742 | 0.050 1 |

| 100 | 7.712 | 0.045 1 | ||

| Rest-NoStack | 20 | 2.92×10-4 | 0.762 1 | |

| 100 | 4.25×10-5 | 0.722 1 | ||

| NoAdv-Stack | 20 | 3.01×10-4 | 0.755 0 | |

| 100 | 4.50×10-5 | 0.715 1 |