1 文献回顾与讨论

1.1 产业布局

1.2 推荐算法与大语言模型

表 1 本文结构化推荐算法与大语言模型对比 |

| 比较维度 | 本文结构化推荐算法 | 大语言模型 |

| 数据类型适配 | 强(支持结构化、多通道数据) | 弱(主要处理自然语言, 需手工prompt转换) |

| 冷启动适配能力 | 高(负样本+基于相似性的构建机制) | 弱(依赖语言先验信息, 结构稀疏难泛化) |

| 高阶交互建模能力 | 强(多头注意力+神经矩阵分解) | 弱(缺乏结构交互建模机制) |

| 推理效率与资源需求 | 高效(可本地化部署) | 极高(推理成本高, 响应慢) |

| 可解释性 | 强(注意力热力图可视化) | 弱(黑箱输出, 难以解释) |

| 跨行业通用性 | 中(可定制化) | 弱(需训练或prompt工程, 大幅迁移困难) |

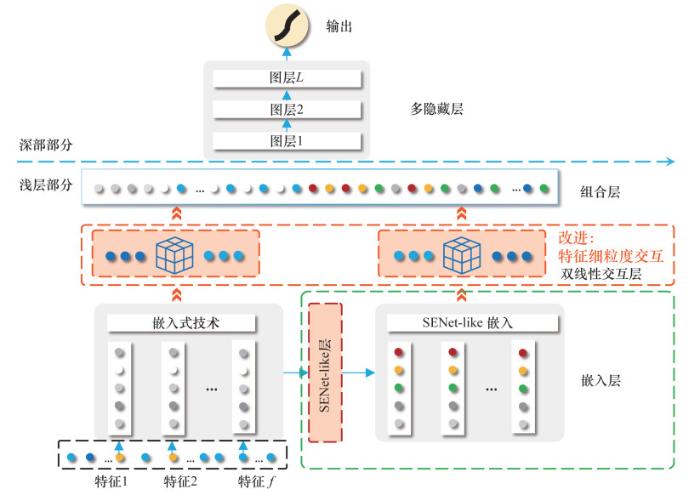

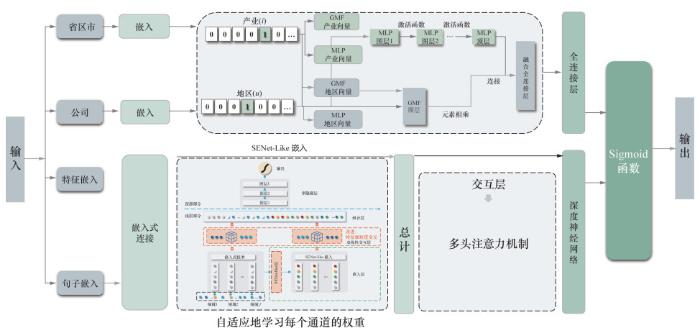

2 产业布局推荐算法框架

2.1 算法概况

2.2 嵌入表示层

2.3 基于SENet-like的特征重标定

2.4 多头注意力机制捕捉动态关系

2.5 深度神经网络

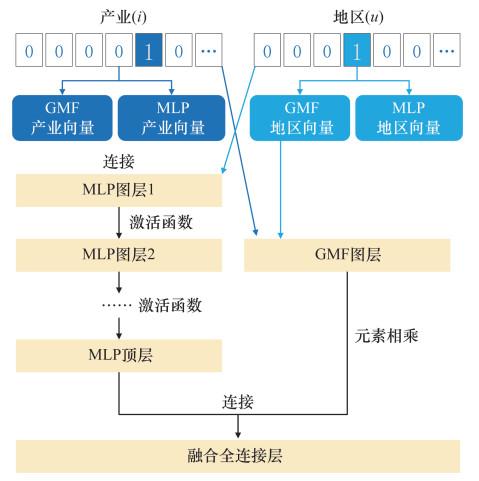

2.6 神经矩阵分解学习交互模式

2.7 最终预测得分获取

2.8 算法创新点总结

3 模型训练与评估方法

3.1 数据来源与预处理

表 2 数据处理方法汇总 |

| 输入特征类型 | 处理方式 | 举例说明 |

| 连续型数值特征 | 归一化或标准化 | GDP总量、研发投入强度、产业增长率等 |

| 稀疏分类特征 | 嵌入表示层编码 | 城市ID、产业类别编码 |

| 政策文本特征(密集向量) | BERT编码(128维) | 地方政府发布的产业政策文件嵌入向量 |

| 衍生交互特征 | 归一化、标准化或特征工程处理 | 招商成功率、产业链匹配度、人才流动性等衍生特征 |

3.2 模型训练过程

表 3 超参数设置 |

| 参数名 | 描述 | 数值 |

| Embedding-dim | 特征编码维度 | 128 |

| Epoch | 训练轮次 | 100 |

| Patience | 早停策略的耐心值 | 10 |

| Learn-rate | 学习率 | 1×10-3 |

| Attention_head | 注意力头数 | 8 |

| Attention_dim | 注意力嵌入向量维度 | 32 |

| Dropout | 神经元丢弃率 | 0.2 |

| Weight-decay | L2正则化系数 | 1×10-5 |

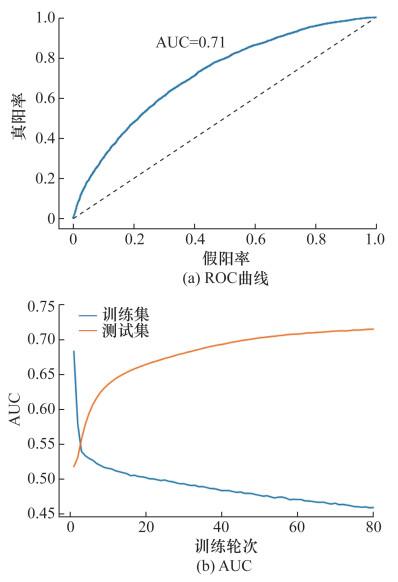

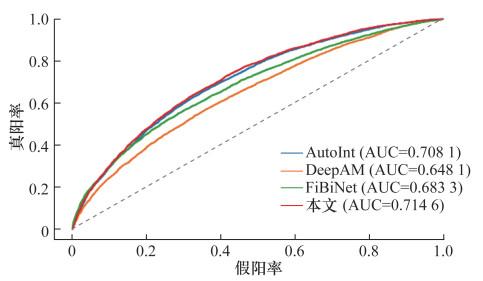

3.3 总体性能分析

3.4 与另外3种推荐算法的对比实验分析

表 4 各推荐算法性能对比 |

| 算法 | logloss | AUC |

| DeepFM | 0.546 786 | 0.648 090 |

| AutoInt | 0.485 895 | 0.708 091 |

| FiBiNet | 0.658 292 | 0.683 292 |

| 本文 | 0.485 869 | 0.714 614 |

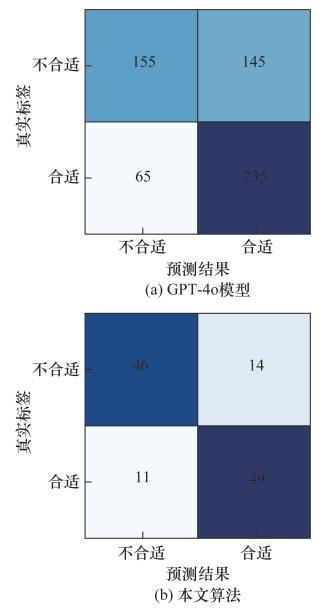

3.5 与直接使用大语言模型的对比实验分析

表 5 本文算法与3种大语言模型的性能对比 |

| 模型 | 准确率 | 召回率 | F1 | AUC |

| GPT-4o | 0.655 | 0.816 | 0.703 | 0.676 |

| Qwen-2.5-72B-Instruct | 0.601 | 0.693 | 0.635 | 0.621 |

| Llama-3.1-70B | 0.620 | 0.663 | 0.635 | 0.639 |

| 本文 | 0.791 | 0.766 | 0.786 | 0.823 |

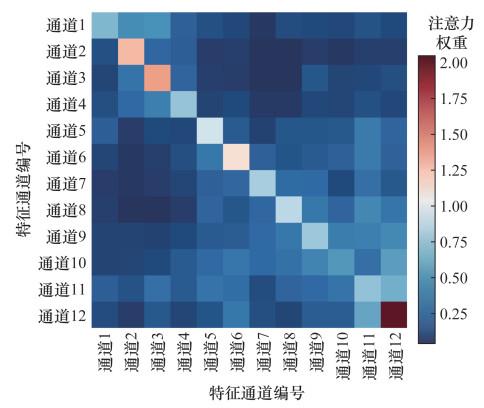

3.6 模型的可解释性

3.7 部分产业布局推荐结果

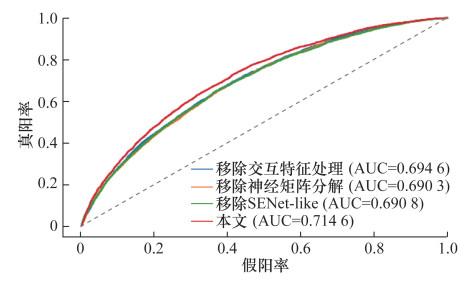

4 消融实验与拓展分析

4.1 消融实验

表 7 消融实验的logloss和AUC结果 |

| 模型 | logloss | AUC |

| 移除交互特征处理 | 0.492 854 | 0.694 599 |

| 移除神经矩阵分解 | 0.495 180 | 0.690 282 |

| 移除SENet-like | 0.495 028 | 0.690 787 |

| 本文模型 | 0.485 869 | 0.714 614 |